Los investigadores de NYU han identificado cientos de grupos de usuarios de Instagram, algunos con miles de miembros, que intercambian sistemáticamente Me gusta y comentarios para jugar con los algoritmos del servicio y aumentar la visibilidad. En el proceso, también capacitaron a agentes de aprendizaje automático para identificar si una publicación se ha aprovechado de esta manera.

Los “pods”, como se los ha denominado, se colocan a horcajadas en la línea entre el compromiso real y el falso, lo que los hace difíciles de detectar o tomar medidas contra ellos. Y aunque solían ser una amenaza de nicho (y todavía se comparan con la cuenta falsa y la actividad de bot), la práctica está creciendo en volumen y eficacia.

Los pods se encuentran fácilmente mediante búsquedas en línea, y algunos están abiertos al público. El lugar más común para ellos es Telegram, ya que es más o menos seguro y no tiene límite para la cantidad de personas que pueden estar en un canal. Las publicaciones vinculadas en el pod son gustadas y comentadas por otros en el grupo, con el efecto de que esas publicaciones sean mucho más propensas a ser difundidas ampliamente por Instagram algoritmos de recomendación, impulsando el compromiso orgánico.

Reciprocidad como servicio

La práctica de los grupos que se gustan mutuamente a las publicaciones se llama abuso de reciprocidad, y las redes sociales son muy conscientes de ello, ya que han eliminado configuraciones de este tipo antes. Pero la práctica nunca ha sido estudiada o caracterizada en detalle, explicó el equipo de la Escuela de Ingeniería Tandon de NYU.

“En el pasado, probablemente se hayan centrado más en amenazas automatizadas, como dar credenciales a alguien para que las use, o cosas hechas por bots”, dijo la autora principal del estudio Rachel Greenstadt. “Prestamos atención a esto porque es un problema creciente y es más difícil tomar medidas en contra”.

A pequeña escala no parece demasiado amenazante, pero el estudio encontró cerca de 2 millones de publicaciones que habían sido manipuladas por este método, con más de 100,000 usuarios participando en pods. Y esos son solo los que están en inglés, que se encuentran utilizando datos disponibles públicamente. El documento que describe la investigación se publicó en las Actas de la Conferencia de la World Wide Web y se puede leer aquí.

Es importante destacar que el gusto recíproco hace más que inflar el compromiso aparente. Las publicaciones enviadas a los pods obtuvieron un gran número de me gusta y comentarios artificiales, sí, pero esa actividad engañó al algoritmo de Instagram para promoverlos aún más, lo que generó mucho más compromiso incluso en las publicaciones no enviado a la cápsula.

Cuando se contactó para comentar, Instagram inicialmente dijo que esta actividad “viola nuestras políticas y tenemos numerosas medidas para detenerla”, y dijo que los investigadores no habían colaborado con la compañía en la investigación.

De hecho, el equipo estuvo en contacto con el equipo de abuso de Instagram desde el principio del proyecto y, según el estudio, parece claro que las medidas implementadas, al menos en este contexto, no tuvieron el efecto deseado. Se lo señalé al representante y actualizaré esta publicación si recibo más información.

“Es un área gris”

Pero todavía no busque las horcas: el hecho es que este tipo de actividad es notablemente difícil de detectar, porque en realidad es idéntico en muchos aspectos a un grupo de amigos o usuarios de ideas afines que interactúan con el contenido de los demás exactamente como le gustaría a Instagram. Y realmente, incluso clasificar el comportamiento como abuso no es tan simple.

“Es un área gris, y creo que las personas en Instagram piensan que es un área gris”, dijo Greenstadt. “¿Dónde termina? Si escribes un artículo y lo publicas en las redes sociales y lo envías a tus amigos, y les gusta, y a veces lo hacen por ti, ¿eres parte de un pod? El problema aquí no es necesariamente ese la gente está haciendo esto, pero cómo el algoritmo debería tratar esta acción, en términos de amplificar o no amplificar ese contenido “.

Obviamente, si las personas lo hacen sistemáticamente con miles de usuarios e incluso cobran por el acceso (como lo hacen algunos grupos), eso equivale a abuso. Pero dibujar la línea no es fácil.

Lo más importante es que la línea no se puede trazar a menos que primero defina el comportamiento, lo que hicieron los investigadores al inspeccionar cuidadosamente las diferencias en los patrones de me gusta y comentarios en publicaciones impulsadas por pod y ordinarias.

“Tienen firmas lingüísticas diferentes”, explicó la coautora Janith Weerasinghe. “Qué palabras usan, los patrones de tiempo”.

Como es de esperar, los extraños obligados a comentar en publicaciones que en realidad no les importan tienden a usar un lenguaje genérico, diciendo cosas como “buena foto” o “guau” en lugar de comentarios más personales. Algunos grupos realmente advierten contra esto, dijo Weerasinghe, pero no muchos.

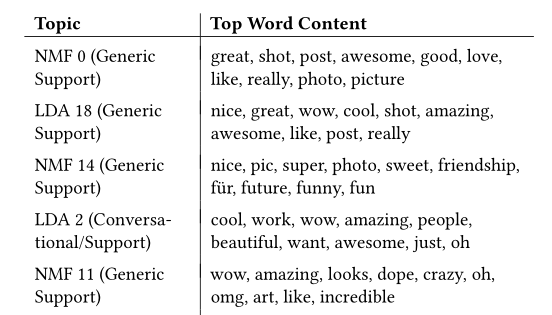

La lista de las principales palabras utilizadas lee, como era de esperar, como la sección de comentarios en cualquier publicación popular, aunque tal vez eso habla de una falta de expresividad más general en Instagram que cualquier otra cosa:

Pero el análisis estadístico de miles de publicaciones de este tipo, tanto con alimentación de pod como normales, mostró una prevalencia claramente mayor de comentarios de “soporte genérico”, que a menudo se muestran en un patrón predecible.

Pero el análisis estadístico de miles de publicaciones de este tipo, tanto con alimentación de pod como normales, mostró una prevalencia claramente mayor de comentarios de “soporte genérico”, que a menudo se muestran en un patrón predecible.

Estos datos se usaron para entrenar un modelo de aprendizaje automático, que cuando se soltó en publicaciones que nunca había visto, pudo identificar publicaciones que recibieron el tratamiento de cápsulas con una precisión de hasta el 90%. Esto podría ayudar a sacar a la superficie otras cápsulas, y no se equivoquen, esta es solo una pequeña muestra de lo que hay ahí fuera.

“Obtuvimos una muestra bastante buena para el período de tiempo de las cápsulas fácilmente accesibles y fáciles de encontrar”, dijo Greenstadt. “La gran parte del ecosistema que nos falta son las cápsulas que son más pequeñas pero más lucrativas, que ya deben tener cierta presencia en las redes sociales para unirse. No somos personas influyentes, por lo que realmente no podríamos medir eso “.

El número de pods y las publicaciones que manipulan ha crecido constantemente en los últimos dos años. Se encontraron alrededor de 7,000 publicaciones durante marzo de 2017. Un año después, ese número había aumentado a casi 55,000. En marzo de 2019 se registraron más de 100,000, y el número continuó aumentando hasta el final de los datos del estudio. Es seguro decir que los pods ahora se publican más de 4.000 veces al día, y cada uno recibe una gran cantidad de compromiso, tanto artificial como orgánico. Las cápsulas ahora tienen 900 usuarios en promedio, y algunos tenían más de 10,000.

Tal vez esté pensando: “Si un puñado de académicos que usan API disponibles públicamente y Google podrían resolver esto, ¿por qué no tiene Instagram?”

Como se mencionó anteriormente, es posible que los equipos simplemente no lo hayan considerado una amenaza importante y, en consecuencia, no hayan creado políticas o herramientas para evitarlo. Las reglas que prohíben el uso de una “aplicación o servicio de terceros para generar me gusta, seguimientos o comentarios falsos” posiblemente no se apliquen a estos pods, ya que en muchos sentidos son idénticos a las redes de usuarios perfectamente legítimas (aunque Instagram aclaró que considera vainas como violando la regla). Y ciertamente la amenaza de cuentas falsas y bots es de mayor escala.

Y aunque es posible que las cápsulas se puedan usar como un lugar para la desinformación patrocinada por el estado u otros fines políticos, el equipo no notó que sucediera algo en ese sentido (aunque no lo estaban buscando específicamente). Entonces, por ahora, las apuestas son relativamente pequeñas.

Dicho esto, Instagram claramente tiene acceso a datos que ayudarían a definir y detectar este tipo de comportamiento, y sus políticas y algoritmos podrían cambiarse para acomodarlo. Sin duda, a los investigadores de la NYU les encantaría ayudar.