en un nuevo reporteAmnistía Internacional dice que ha encontrado evidencia de empresas de la UE que venden tecnologías de vigilancia digital a China, a pesar de los graves riesgos para los derechos humanos de tecnologías como el reconocimiento facial que terminan en manos de un régimen autoritario que ha estado acorralando a los uigures étnicos y reteniéndolos. campamentos de “reeducación”.

La organización benéfica de derechos humanos ha pedido al bloque que actualice su marco de exportación, dado que la exportación de la mayoría de las tecnologías de vigilancia digital actualmente no está regulada, instando a los legisladores de la UE a incluir un requisito para considerar los riesgos para los derechos humanos con carácter de urgencia.

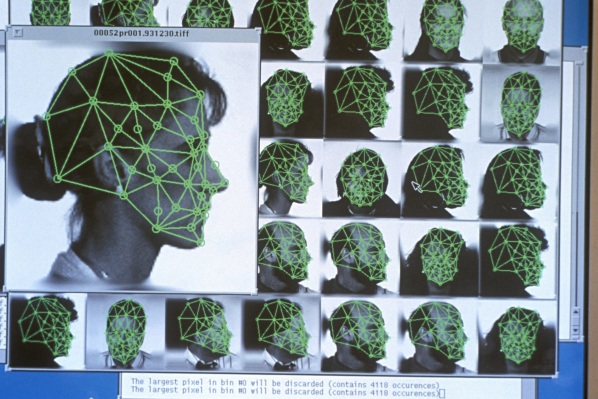

“La regulación actual de exportaciones de la UE (es decir, la Regulación de doble uso) no aborda la dinámica de vigilancia que cambia rápidamente y no mitiga los riesgos emergentes que plantean las nuevas formas de tecnologías de vigilancia digital. [such as facial recognition tech]”, escribe. “Estas tecnologías se pueden exportar libremente a todos los compradores del mundo, incluidas las oficinas de seguridad pública chinas. El marco de regulación de las exportaciones tampoco obliga a las empresas exportadoras a llevar a cabo la diligencia debida en materia de derechos humanos, lo cual es inaceptable teniendo en cuenta el riesgo para los derechos humanos asociado con las tecnologías de vigilancia digital”.

“El marco de regulación de las exportaciones de la UE necesita ser arreglado, y lo necesita rápido”, agrega, diciendo que hay una ventana de oportunidad ya que la legislatura europea está en proceso de modificar el marco de regulación de las exportaciones.

El informe de Amnistía contiene una serie de recomendaciones para actualizar el marco de modo que pueda responder a los rápidos avances en la tecnología de vigilancia, incluido decir que el alcance del Reglamento refundido de doble uso debe ser “neutral desde el punto de vista tecnológico” y sugerir que se imponen obligaciones a la exportación. empresas para llevar a cabo la debida diligencia en materia de derechos humanos, independientemente de su tamaño, ubicación o estructura.

Nos hemos puesto en contacto con la Comisión Europea para obtener una respuesta al llamamiento de Amnistía para que actualice el marco de exportación de la UE.

El informe identifica tres empresas con sede en la UE: el proveedor de soluciones de autenticación biométrica Morpho (ahora Idemia) de Francia; el fabricante de cámaras en red Axis Communications de Suecia; y el proveedor de software de investigación del comportamiento humano (y animal) Noldus Information Technology de los Países Bajos, por haber exportado herramientas de vigilancia digital a China.

“Estas tecnologías incluían software de reconocimiento facial y de emociones, y ahora son utilizadas por las oficinas de seguridad pública de China, las agencias de aplicación de la ley penal y/o los institutos de investigación relacionados con el gobierno, incluso en la región de Xinjiang”, escribe, refiriéndose a una región de noroeste de China, hogar de muchas minorías étnicas, incluidos los uigures perseguidos.

“Ninguna de las empresas cumplió con sus responsabilidades de diligencia debida en materia de derechos humanos para estas transacciones, según lo prescrito por el derecho internacional de los derechos humanos”, agrega. “Las exportaciones plantean riesgos significativos para los derechos humanos”.

Amnistía sugiere que los riesgos que plantean algunas de las tecnologías que ya se han exportado de la UE incluyen la interferencia con el derecho a la privacidad, como la eliminación de la posibilidad de que las personas permanezcan anónimas en espacios públicos, así como la interferencia con la no discriminación. la libertad de opinión y expresión, y los impactos potenciales sobre los derechos de reunión y asociación también.

Nos pusimos en contacto con las tres empresas de la UE mencionadas en el informe.

En el momento de escribir este artículo, solo Axis Communications había respondido, indicándonos un declaración públicadonde escribe que sus soluciones de video en red se “utilizan en todo el mundo para ayudar a aumentar la seguridad”, y agrega que “siempre” respeta los derechos humanos y se opone a la discriminación y la represión “en cualquier forma”.

“En relación con la ética de cómo nuestros clientes utilizan nuestras soluciones, los clientes son examinados sistemáticamente para resaltar cualquier restricción legal o inclusión en listas de sanciones nacionales e internacionales”, también afirma, aunque la declaración no hace referencia a por qué este proceso no le impidió vender su tecnología a China.

Actualizar: Noldus Information Technology ahora también envió una declaración, en la que niega la fabricación de herramientas de vigilancia digital y argumenta que el software de su herramienta de investigación no representa un riesgo para los derechos humanos.

También acusa a Amnistía Internacional de no actuar con la debida diligencia durante su investigación.

“Amnistía Internacional… no ha presentado ni una sola prueba de que se hayan producido violaciones de los derechos humanos, ni ha presentado un solo ejemplo de cómo nuestro software podría ser un riesgo para los derechos humanos”, escribe Noldus. “Con respecto a las ventas a la Universidad de Shihezi y la Universidad Normal de Xinjiang, Amnistía admite que “nuestra investigación no no investigar los vínculos directos entre los proyectos universitarios que involucran productos Noldus y la expansión de la vigilancia y el control estatal en Xinjiang”. Estas universidades, y muchas otras en China, compraron nuestras herramientas para la investigación en psicología educativa y del desarrollo, áreas de aplicación comunes en la investigación académica en todo el mundo, durante un programa nacional para mejorar la infraestructura de investigación en las universidades chinas”.

“Estamos de acuerdo con Amnistía en que se debe prevenir en todo momento el mal uso de la tecnología que podría violar los derechos humanos. También comprendemos y apoyamos la petición de Amnistía Internacional de que se establezcan normas de doble uso más estrictas para controlar la exportación de tecnología de vigilancia masiva. Sin embargo, Noldus Information Technology no fabrica sistemas de vigilancia y no participamos activamente en el mercado de la seguridad pública, por lo que no entendemos por qué Amnistía incluyó a nuestra empresa en su informe”, agrega. “La discusión sobre los riesgos de la tecnología digital para los derechos humanos debe basarse en evidencia, no en sospechas o suposiciones. El enfoque de Amnistía debería haber estado en las tecnologías que representan un riesgo para los derechos humanos, y las herramientas de Noldus no hacen eso”.

En el frente interno, los legisladores europeos están en el proceso de diseñar reglas regionales para el uso de aplicaciones de IA de “alto riesgo” en todo el bloque, con un borrador de propuesta para el próximo año, según un discurso reciente del presidente de la Comisión.

Hasta ahora, el ejecutivo de la UE se ha alejado de una sugerencia anterior de que podría buscar una prohibición temporal del uso de tecnología de reconocimiento facial en lugares públicos. También parece estar a favor de una regulación más ligera, que define solo un subconjunto de aplicaciones de “alto riesgo”, en lugar de imponer prohibiciones generales. Además, los legisladores regionales han buscado un debate “amplio” sobre las circunstancias en las que podría justificarse el uso remoto de la identificación biométrica, lo que sugiere que todavía no hay nada fuera de la mesa.