Los vehículos autónomos dependen de muchos sensores para percibir el mundo que los rodea, y aunque las cámaras y el lidar reciben mucha atención, el buen radar antiguo es una pieza importante del rompecabezas, aunque tiene algunas limitaciones fundamentales. Oculii, que acaba de recaudar una ronda de $ 55 millones, tiene como objetivo minimizar esas limitaciones y hacer que el radar sea más capaz con una capa de software inteligente para los dispositivos existentes, y también vender la suya propia.

Las ventajas del radar radican en su rango superior y en el hecho de que sus haces de radiofrecuencia pueden atravesar cosas como gotas de lluvia, nieve y niebla, lo que lo hace crucial para percibir el medio ambiente durante las inclemencias del tiempo. Las cámaras Lidar y de luz visible ordinarias pueden quedar totalmente desconcertadas por estos eventos comunes, por lo que es necesario tener una copia de seguridad.

Pero la principal desventaja del radar es que, debido a las longitudes de onda y al funcionamiento de las antenas, no puede obtener imágenes de las cosas en detalle como lo hace el lidar. Tiende a obtener manchas ubicadas con mucha precisión en lugar de formas detalladas. Todavía proporciona capacidades invaluables en un conjunto de sensores, pero si alguien pudiera agregar un poco de fidelidad adicional a sus escaneos, sería mucho mejor.

Eso es exactamente lo que hace Oculii: tomar un radar común y recargarlo. La compañía afirma una mejora de 100 veces en la resolución espacial lograda al entregar el control del sistema a su software. El cofundador y director ejecutivo, Steven Hong, explicó en un correo electrónico que un radar estándar podría tener, para un campo de visión de 120 grados, una resolución espacial de 10 grados, por lo que puede decir dónde está algo con una precisión de unos pocos grados a cada lado. y poca o ninguna capacidad para determinar la elevación del objeto.

Algunos son mejores, otros peores, pero para los propósitos de este ejemplo, eso equivale a una resolución efectiva de 12 × 1. ¡No es bueno!

Sin embargo, entregar el control al sistema Oculii, que ajusta inteligentemente las transmisiones en función de lo que ya está percibiendo, podría elevarlo a una resolución horizontal de 0,5 ° x 1 ° vertical, lo que le da una resolución efectiva de quizás 120 × 10. (Nuevamente, estos números son puramente explicativos y no son inherentes al sistema).

Eso es una gran mejora y da como resultado la capacidad de ver que algo son, por ejemplo, dos objetos cerca uno del otro y no uno grande, o que un objeto es más pequeño que otro cerca de él, o – con cálculo adicional – que se está moviendo. de una forma u otra a tal o cual velocidad relativa a la unidad de radar.

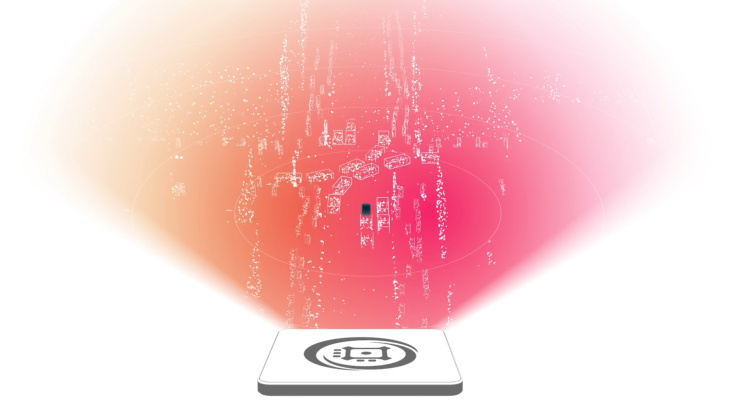

Aquí hay una demostración en video de uno de sus propios dispositivos, que muestra muchos más detalles de los que cabría esperar:

Exactamente cómo se hace esto es parte de la magia patentada de Oculii, y Hong no dio muchos detalles sobre cómo funciona exactamente el sistema. “El sensor de Oculii usa IA para generar de forma adaptativa una forma de onda ‘inteligente’ que se adapta al entorno e incrusta información a lo largo del tiempo que se puede aprovechar para mejorar la resolución de manera significativa”, dijo. (La integración de información a lo largo del tiempo es lo que le da el apodo de “4D”, por cierto).

Aquí hay un pequeño carrete chisporroteante que da una idea muy general:

Los fabricantes de vehículos autónomos aún no han encontrado ningún conjunto canónico de sensores que los AV deberían tener, pero algo como Oculii podría darle al radar un lugar más prominente; sus limitaciones a veces significan que está relegado a la detección de frenado de emergencia en la parte delantera o en alguna situación similar. Con más detalles y más datos, el radar podría desempeñar un papel más importante en los sistemas de toma de decisiones AV.

La compañía definitivamente está haciendo tratos: está trabajando con Tier-1 y OEM, uno de los cuales (Hella) es un inversor, lo que da una sensación de confianza en el enfoque de Oculii. También está trabajando con fabricantes de radares y tiene algunos contratos comerciales que contemplan una línea de tiempo 2024-2025.

Créditos de imagen: Oculii

También se está metiendo en la fabricación de sus propias unidades de radar todo en uno, haciendo la cosa de la sinergia hardware-software. Afirma que estos son los radares de mayor resolución del mundo, y no veo a ningún competidor que contradiga esto; el simple hecho es que los radares no compiten mucho en “resolución”, sino más en la precisión de su alcance y detección de velocidad.

Una excepción podría ser Echodyne, que utiliza una superficie de radar de metamaterial para dirigir un rayo de radar personalizable a cualquier lugar de su campo de visión, examinando objetos en detalle o escaneando toda el área rápidamente. Pero incluso entonces su “resolución” no es tan fácil de estimar.

En cualquier caso, los nuevos radares Eagle y Falcon de la compañía podrían resultar tentadores para los fabricantes que trabajan en la creación de conjuntos de sensores de vanguardia para sus experimentos autónomos o sistemas de asistencia al conductor de producción.

Está claro que con el radar considerado como un componente importante de vehículos autónomos, robots, aviones y otros dispositivos, vale la pena invertir seriamente en el espacio. La ronda de $ 55 MB ciertamente lo demuestra bastante bien. Fue, como lo indica el comunicado de prensa de Oculii, “codirigido por Catapult Ventures y Conductive Ventures, con la participación de Taiwania Capital, Susquehanna Investment Group (SIG), HELLA Ventures, PHI-Zoyi Capital, R7 Partners, VectoIQ, ACVC Partners, Mesh Ventures, Schox Ventures y Signature Bank “.

El dinero permitirá el escalado y la contratación esperados y, como agregó Hong, “la inversión continua de la tecnología para ofrecer una resolución más alta, un rango más largo, sensores más compactos y más baratos que acelerarán un futuro autónomo”.