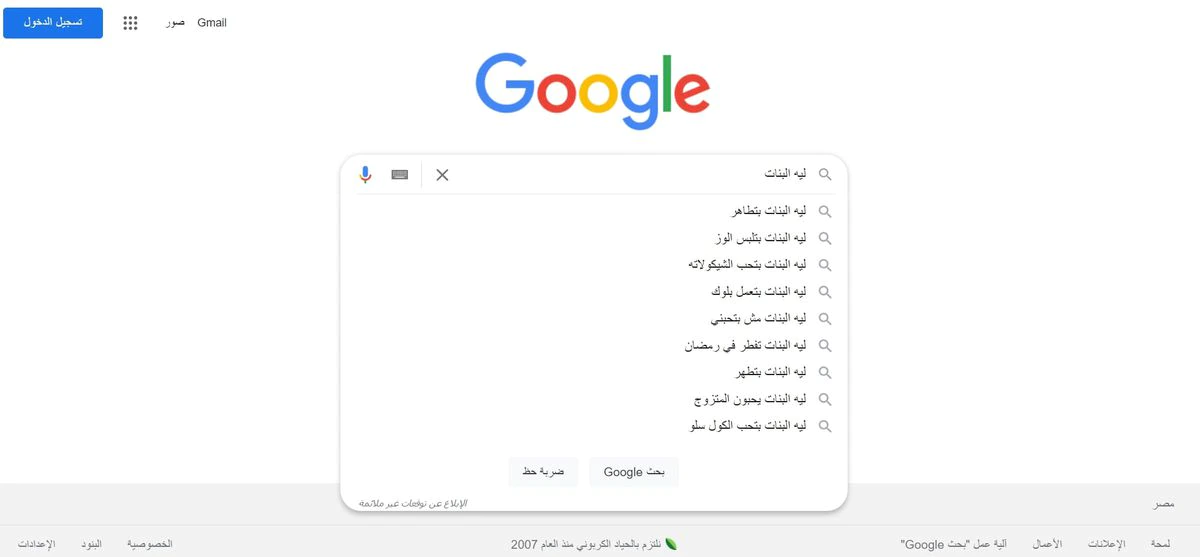

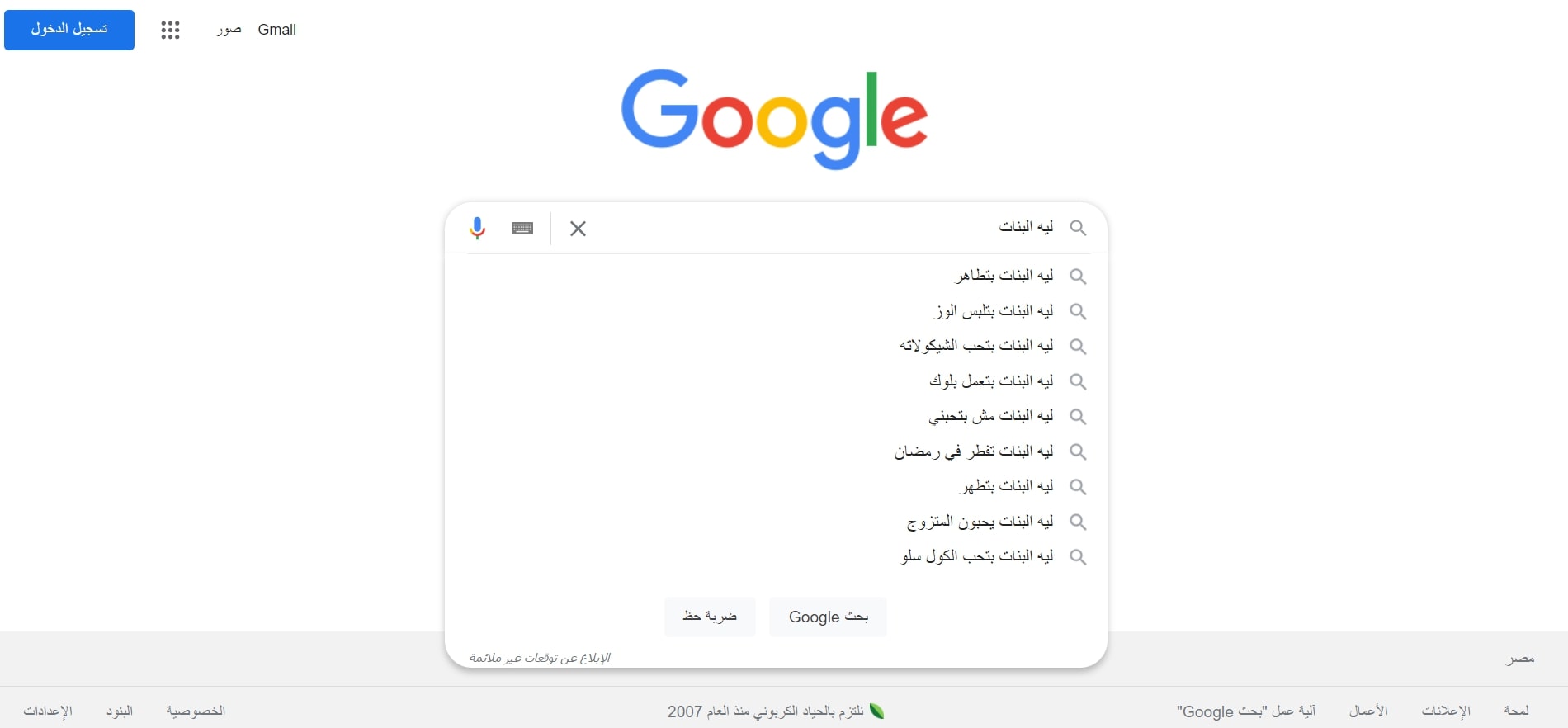

Cuando Youmna Hashem empezó a poner a prueba el motor de búsqueda de Google no tardó en darse cuenta de los peligros que entrañaba. Uno de sus primeros experimentos fue escribir, en árabe egipcio, la pregunta incompleta “por qué las mujeres…”, y esperar a ver dónde le llevaba la sugerencia del buscador más popular del mundo. El resultado fue una cascada de proposiciones de cariz misógino como “por qué las mujeres egipcias son tan quejicas”, y las recomendaciones que aparecían a continuación giraban principalmente en torno al estereotipo de la mujer dada al drama.

“La primera vez que lo hice estaba estudiando un máster y recuerdo haber leído sobre algunos de los problemas con los que se había topado Google a la hora de sugerir, y que estaba siendo criticado por autocompletar las consultas de búsqueda de una forma muy problemática”, explica Hashem, hoy investigadora sobre inteligencia artificial en la empresa de ciencia de datos egipcia Synapse Analytics. “Cuando vi que empezaban a solucionarlo, me dije: ‘Seguro que, si lo pruebo en árabe, encontraré cosas muy problemáticas”, agrega.

Recientemente, Hashem se preguntó si, unos años después de aquel primer experimento, Google habría abordado el problema. Así que procedió a repetir la búsqueda con una sutil variación: “Por qué las chicas…”. Los resultados fueron aún más preocupantes. La primera opción que le apareció podría traducirse por algo así como “por qué se circuncidan las chicas”, una práctica criminal muy extendida en Egipto. El resultado más destacado era, además, un artículo antiguo y del todo infundado que describe los beneficios de la operación.

El problema era aún más profundo de lo que el orden de sugerencias suscitaba. El verbo de la primera opción que le apareció se puede traducir por “circuncidar” si se está familiarizado con el léxico empleado para referirse a esta práctica. Pero literalmente la frase que le proponía Google era algo así como “por qué las chicas se purifican”, puesto que así se refieren a ella muchos egipcios. Por si todo ello no fuera ya lo suficientemente alarmante, el motor de búsqueda vinculaba de forma automática aquel verbo con “circuncidar”, similar a la práctica masculina. Pero, en cambio, no hacía lo propio con el equivalente a “mutilación genital femenina”, que es el que intentan impulsar muchas activistas y académicas.

“La tecnología y un servicio como Google no son abstractos, sino que son moldeados por nosotros y por cómo interactuamos con ellos. Al final somos sus diseñadores y usuarios, por lo que acaban reflejando todo lo que ocurre en la sociedad”, nota Hashem. “[Pero] lo que me ha sorprendido es que en algo tan sensible como la mutilación genital femenina (MGF), Google no se hubiera esforzado, que no hubiera hecho el mismo esfuerzo que en otros idiomas, concretamente en el árabe, para eliminar o no permitir que ese contenido aparezca primero”, señala.

Hashem fue todavía más allá y, tal y como explica en un artículo reciente más detallado, buscó en qué gobernaciones de Egipto se hacen más búsquedas en Google acerca de la mutilación genital femenina. Las principales incluían varias provincias del delta del Nilo, en el norte del país, donde los informes precisamente recogen que esta práctica continúa siendo muy frecuente a pesar de ser legalmente un crimen.

“Un gran problema a nivel mundial, pero especialmente en nuestra parte del mundo, es la cuestión del analfabetismo digital: la gente no sabe distinguir entre lo que es fiable y lo que no”, alerta la investigadora, “y esto puede tener algunas ramificaciones peligrosas en algo como la MGF, porque todavía se practica mucho en Egipto”.

Motores de búsqueda como el de Google son programas informáticos diseñados para rastrear internet y crear un repositorio con el objetivo de ofrecer un sistema que organice toda esta información y la haga accesible a fin de que, cuando los usuarios escriban lo que están buscando, les aparezca con la máxima precisión posible aquello que quieren hallar. No se trata de una misión fácil. Motores de búsqueda de este tipo no entienden el sentido de las palabras, sino que se basan en modelos estadísticos, en patrones de búsquedas anteriores, para identificar lo que está intentando hallar un usuario.

Uno de los problemas que esto conlleva es cuando los motores de búsqueda tienen poco contenido creíble y relevante que se ajuste a aquello que se está buscando, los llamados “vacíos de datos”. En muchos casos, estas brechas implicarán que las sugerencias que planteen sean de baja calidad. Pero en ocasiones pueden acabar reforzando estereotipos o comportamientos problemáticos, como en los casos buscados por Hashem.

En el caso del árabe, estos vacíos representan un gran desafío. A pesar de ser uno de los idiomas más hablados del mundo, apenas un 1,3% del contenido en línea está en árabe, según datos de W3Techs, que proporciona información sobre el uso de tecnologías en la web. Una abismal desproporción que deja grandes lagunas de información por el camino. En idiomas como el inglés, de lejos el más común, empresas como Google han dedicado especiales recursos para abordar vacíos problemáticos. Pero en árabe van muy por detrás.

“Es un equilibrio muy delicado”, concede Hashem. “Google es una organización sin una postura política específica, por lo que es muy difícil para ellos llegar a un acuerdo sobre cómo equilibrar la libertad de expresión y, por otro lado, decir que se está cruzando una línea aquí o que esto es una información errónea”, nota. “En inglés, Google es muy rápido en responder y tiene grandes mecanismos para denunciar”, apunta, “pero el problema es que hay que invertir más en los idiomas que no son el inglés”. “Tienen que invertir más en contenidos alternativos; invertir más en sus diferentes regiones y audiencias, no solo en las de habla inglesa”, desliza.

En esta línea, también ganan fuerza las llamadas a descolonizar la inteligencia artificial. “El enfoque decolonial consistiría en formas alternativas de conocimiento y de creación y producción de conocimiento. Y en hacer que la tecnología esté menos centralizada, y en lugar de que las grandes tecnológicas sean las que establezcan el escenario y la política y den forma y dicten el futuro de la tecnología, hacerlo más comunitario”, apunta Hashem.

Puedes seguir a EL PAÍS TECNOLOGÍA en Facebook y Twitter o apuntarte aquí para recibir nuestra newsletter semanal.