Los trabajos de investigación salen demasiado rápido para que alguien los lea todos, especialmente en el campo del aprendizaje automático, que ahora afecta (y produce artículos) prácticamente a todas las industrias y empresas. Esta columna tiene como objetivo recopilar los descubrimientos y documentos recientes más relevantes, particularmente en inteligencia artificial, entre otros, y explicar por qué son importantes.

Esta semana, una startup que utiliza drones UAV para mapear bosques, analiza cómo el aprendizaje automático puede mapear redes sociales y predecir el Alzheimer, mejorar la visión por computadora para sensores basados en el espacio y otras noticias sobre avances tecnológicos recientes.

Predecir el Alzheimer a través de los patrones del habla

Las herramientas de aprendizaje automático se utilizan para ayudar al diagnóstico de muchas maneras, ya que son sensibles a patrones que los humanos encuentran difíciles de detectar. Los investigadores de IBM potencialmente han encontrado tales patrones en el habla que son predictivo de que el hablante desarrolle la enfermedad de Alzheimer.

El sistema solo necesita un par de minutos de habla ordinaria en un entorno clínico. El equipo utilizó un gran conjunto de datos (el Estudio del corazón de Framingham) que se remonta a 1948, lo que permitió identificar patrones de habla en personas que luego desarrollarían la enfermedad de Alzheimer. La tasa de precisión es de alrededor del 71 % o 0,74 del área bajo la curva para aquellos de ustedes más informados estadísticamente. Eso está lejos de ser seguro, pero las pruebas básicas actuales son apenas mejores que lanzar una moneda al aire para predecir la enfermedad con tanta anticipación.

Esto es muy importante porque cuanto antes se pueda detectar el Alzheimer, mejor se podrá controlar. No hay cura, pero existen tratamientos y prácticas prometedoras que pueden retrasar o mitigar los peores síntomas. Una prueba rápida y no invasiva de personas sanas como esta podría ser una nueva y poderosa herramienta de detección y, por supuesto, también es una excelente demostración de la utilidad de este campo de la tecnología.

(No lea el documento esperando encontrar síntomas exactos ni nada por el estilo; la variedad de características del habla no es realmente el tipo de cosas que puede buscar en la vida cotidiana).

Redes de células so

Asegurarse de que su red de aprendizaje profundo se generalice a datos fuera de su entorno de capacitación es una parte clave de cualquier investigación seria de ML. Pero pocos intentan liberar un modelo con datos que le son completamente extraños. ¡Quizás deberían!

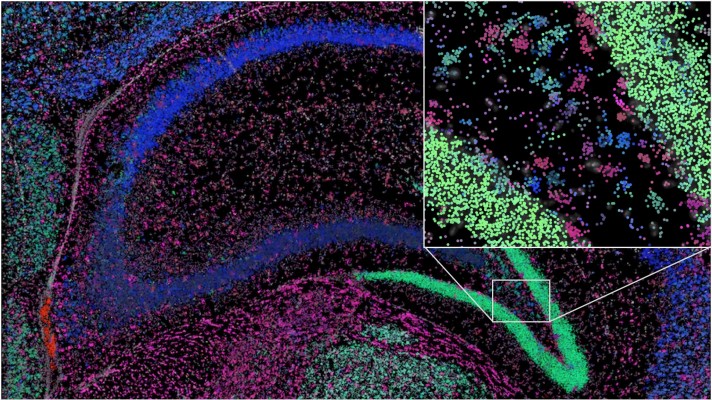

Investigadores de la Universidad de Uppsala en Suecia tomó un modelo utilizado para identificar grupos y conexiones en las redes sociales y lo aplicó (no sin modificar, por supuesto) a escaneos de tejido. El tejido había sido tratado para que las imágenes resultantes produjeran miles de pequeños puntos que representaban el ARNm.

Normalmente, los diferentes grupos de células, que representan tipos y áreas de tejido, tendrían que identificarse y etiquetarse manualmente. Pero la red neuronal gráfica, creada para identificar grupos sociales en función de similitudes como intereses comunes en un espacio virtual, demostró que podía realizar una tarea similar en las células. (Ver la imagen en la parte superior.)

“Estamos utilizando los últimos métodos de IA, específicamente, redes neuronales gráficas, desarrolladas para analizar redes sociales, y adaptándolas para comprender patrones biológicos y variaciones sucesivas en muestras de tejido. Las células son comparables a agrupaciones sociales que se pueden definir según las actividades que comparten en sus redes sociales”, dijo Carolina Wählby de Uppsala.

Es una ilustración interesante no solo de la flexibilidad de las redes neuronales, sino de cómo las estructuras y arquitecturas se repiten en todas las escalas y en todos los contextos. Como afuera, así adentro, si se quiere.

Drones en la naturaleza

Los vastos bosques de nuestros parques nacionales y granjas madereras tienen innumerables árboles, pero no se puede poner “incontables” en el papeleo. Alguien tiene que hacer una estimación real de qué tan bien están creciendo varias regiones, la densidad y los tipos de árboles, la variedad de enfermedades o incendios forestales, etc. Este proceso solo está parcialmente automatizado, ya que la fotografía aérea y los escaneos solo revelan mucho, mientras que la observación en el terreno es detallada pero extremadamente lenta y limitada.

arboleswift tiene como objetivo tomar un camino intermedio al equipar a los drones con los sensores que necesitan para navegar y medir con precisión el bosque. Al volar mucho más rápido que una persona que camina, pueden contar árboles, detectar problemas y, en general, recopilar una tonelada de datos útiles. La compañía aún se encuentra en una etapa muy temprana, ya que se separó de la Universidad de Pensilvania y adquirió una subvención SBIR de la NSF.

“Las empresas buscan cada vez más los recursos forestales para combatir el cambio climático, pero no tienen un suministro de personas que crezcan para satisfacer esa necesidad”, Steven Chen, cofundador y director ejecutivo de Treeswift y estudiante de doctorado en Informática y Ciencias de la información (CIS) en Penn Engineering dijo en una noticia de Penn. “Quiero ayudar a que cada guardabosques haga lo que hace con mayor eficiencia. Estos robots no reemplazarán los trabajos humanos. En cambio, están brindando nuevas herramientas a las personas que tienen el conocimiento y la pasión para administrar nuestros bosques”.

Otra área donde los drones están haciendo muchos movimientos interesantes es bajo el agua. Los sumergibles autónomos oceánicos están ayudando a mapear el fondo del mar, rastrear las plataformas de hielo y seguir a las ballenas. Pero todos tienen un poco de talón de Aquiles en el sentido de que periódicamente deben ser recogidos, cargados y sus datos recuperados.

La profesora de ingeniería de Purdue, Nina Mahmoudian, ha creó un sistema de acoplamiento mediante el cual los sumergibles pueden conectarse fácil y automáticamente para el intercambio de energía y datos.

Un robot marino amarillo (izquierda, bajo el agua) llega a una estación de acoplamiento móvil para recargar y cargar datos antes de continuar con una tarea. (Foto de la Universidad de Purdue/Jared Pike)

La nave necesita una nariz especial, que pueda encontrar y conectarse a una estación que establezca una conexión segura. La estación puede ser una embarcación autónoma en sí misma o una característica permanente en algún lugar; lo que importa es que la embarcación más pequeña pueda hacer una parada en boxes para recargar y informar antes de continuar. Si se pierde (un peligro real en el mar), sus datos no se perderán con él.

Puede ver la configuración en acción a continuación:

https://youtu.be/kS0-qc_r0

Sonido en teoría

Es posible que los drones también se conviertan pronto en elementos fijos de la vida de la ciudad, aunque probablemente estemos lejos de los helicópteros privados automatizados que algunos parecen pensar que están a la vuelta de la esquina. Pero vivir bajo una carretera de drones significa un ruido constante, por lo que las personas siempre buscan formas de reducir la turbulencia y el sonido resultante de las alas y las hélices.

Parece que está en llamas, pero eso es turbulencia.

Investigadores de la Universidad de Ciencia y Tecnología Rey Abdullah encontraron un nueva forma más eficiente de simular el flujo de aire en estas situaciones; la dinámica de fluidos es esencialmente tan compleja como usted la hace, por lo que el truco consiste en aplicar su poder de cómputo a las partes correctas del problema. Pudieron representar solo el flujo cerca de la superficie de la aeronave teórica en alta resolución, y descubrieron que más allá de cierta distancia no tenía mucho sentido saber exactamente lo que estaba sucediendo. Las mejoras a los modelos de la realidad no siempre tienen que ser mejores en todos los sentidos; después de todo, lo que importa son los resultados.

Aprendizaje automático en el espacio

Los algoritmos de visión por computadora han recorrido un largo camino y, a medida que mejora su eficiencia, comienzan a implementarse en el borde en lugar de en los centros de datos. De hecho, se ha vuelto bastante común que los objetos con cámara, como teléfonos y dispositivos IoT, realicen algún trabajo de ML local en la imagen. Pero en el espacio es otra historia.

Créditos de imagen: Coseno

Hasta hace poco, realizar trabajos de aprendizaje automático en el espacio era simplemente demasiado costoso en términos de energía para siquiera considerarlo. Ese es el poder que podría usarse para capturar otra imagen, transmitir los datos a la superficie, etc. HyperScout 2 está explorando la posibilidad de que ML funcione en el espacio y su satélite. ha comenzado a aplicar técnicas de visión artificial inmediatamente a las imágenes que recopila antes de enviarlas. (“Aquí hay una nube, aquí está Portugal, aquí hay un volcán…”)

Por ahora, hay pocos beneficios prácticos, pero la detección de objetos se puede combinar fácilmente con otras funciones para crear nuevos casos de uso, desde ahorrar energía cuando no hay objetos de interés, hasta pasar metadatos a otras herramientas que pueden funcionar mejor si están informados.

Dentro con lo viejo, fuera con lo nuevo

Los modelos de aprendizaje automático son excelentes para hacer conjeturas informadas, y en disciplinas donde hay una gran acumulación de datos sin clasificar o mal documentados, puede ser muy útil dejar que una IA haga un primer intento para que los estudiantes graduados puedan usar su tiempo de manera más productiva. La Biblioteca del Congreso lo está haciendo con periódicos viejos, y ahora las bibliotecas de la Universidad Carnegie Mellon están entrar en el espíritu.

El archivo de fotos de un millón de elementos de CMU está en proceso de digitalización, pero para que sea útil para los historiadores y los navegadores curiosos, debe organizarse y etiquetarse, por lo que se están poniendo a trabajar algoritmos de visión por computadora para agrupar imágenes similares, identificar objetos y ubicaciones, y realizar otras valiosas tareas básicas de catalogación.

“Incluso un proyecto parcialmente exitoso mejoraría en gran medida los metadatos de la colección y podría proporcionar una posible solución para la generación de metadatos si los archivos alguna vez fueran financiados para digitalizar toda la colección”, dijo Matt Lincoln de CMU.

Un proyecto muy diferente, pero que parece estar conectado de alguna manera, es este trabajo de un estudiante de la Escola Politécnica da Universidade de Pernambuco en Brasil, quien tuvo la brillante idea de intentar arreglar algunos mapas antiguos con aprendizaje automático.

La herramienta que usaron toma viejos mapas de dibujo de líneas e intenta crear una especie de imagen satelital basada en ellos usando una Red Adversaria Generativa; Los GAN esencialmente intentan engañarse a sí mismos para crear contenido que no pueden distinguir del real.

Créditos de imagen: Escuela Politécnica de la Universidad de Pernambuco

Bueno, los resultados no son lo que podría llamarse completamente convincentes, pero siguen siendo prometedores. Dichos mapas rara vez son precisos, pero eso no significa que sean completamente abstractos: recrearlos en el contexto de las técnicas cartográficas modernas es una idea divertida que podría ayudar a que estos lugares parezcan menos distantes.