Meta anunció una serie de nuevos bots, funciones y productos impulsados por IA que se lanzarán en sus aplicaciones de mensajería, Meta Quest 3 y las futuras gafas inteligentes Ray-Ban Meta. Las nuevas funciones, que van desde un asistente de IA hasta la edición de imágenes, aprovechan el poder de la IA generativa para hacer que la tecnología de Meta sea mucho más adictiva.

Aunque, según la redacción de Meta, las nuevas experiencias y funciones de IA “le brindan las herramientas para ser más creativo, expresivo y productivo”.

La serie de anuncios centrados en la IA se produjo como parte de la conferencia anual Connect de Meta, donde la compañía anunció sus nuevos auriculares de realidad mixta y planea lanzar gafas inteligentes en asociación con Ray-Ban.

Toda la tecnología de IA se basa en Llama 2, la nueva familia de modelos de IA de acceso abierto de Meta lanzada en julio. El modelo de lenguaje grande está diseñado para generar texto y código en respuesta a indicaciones, y está entrenado en una combinación de datos disponibles públicamente, según Meta. La compañía señaló que Llama 3 saldría en 2024.

Meta también anunció en Connect su nuevo generador de imágenes, Emu, que utilizará para impulsar cosas como pegatinas de IA y edición de imágenes.

Profundicemos en todas las nuevas formas en que Meta usa la IA.

Asistente de IA, respaldado por Bing

El asistente de IA de Meta funciona con Llama 2 LLM. Con: Ahmad Al-Dahle, vicepresidente de GenAI. Créditos de imagen: Meta

El Asistente de IA de Meta está diseñado para brindarle información en tiempo real y generar imágenes fotorrealistas a partir de mensajes de texto en solo segundos. Puede ayudar a planificar un viaje con amigos en un chat grupal, responder preguntas de conocimiento general y buscar en Internet a través de Bing de Microsoft para proporcionar resultados web en tiempo real.

Usando Llama 2, Meta dijo que creó conjuntos de datos especializados anclados en una conversación natural para que las IA respondieran en un tono conversacional y amigable.

“Con Meta AI, vimos la oportunidad de aprovechar esta capacidad y crear un asistente que puede hacer más que simplemente escribir poemas”, dijo el miércoles Ahmad Al-Dahle, vicepresidente de GenAI en Meta. “Detrás de Meta AI, construimos un orquestador. Y puede detectar perfectamente la intención de un usuario a partir de un mensaje y dirigirla a la extensión correcta”.

La primera extensión será la búsqueda web, impulsada por Bing, para ayudar con consultas que requieran información en tiempo real.

“Ya sea que desee conocer la historia de los huevos Benedict, cómo prepararlos o incluso dónde conseguirlos en San Francisco, Meta AI puede ayudarlo a garantizar que tenga acceso a la información más actualizada a través del poder de la búsqueda. ”, dijo Al-Dahle.

El Asistente de IA estará disponible en versión beta en los EE. UU. en WhatsApp, Messenger e Instagram, y pronto llegará a las gafas inteligentes Ray-Ban Meta y a los auriculares Quest 3 VR.

Chatbots de personalidad con IA basados en celebridades

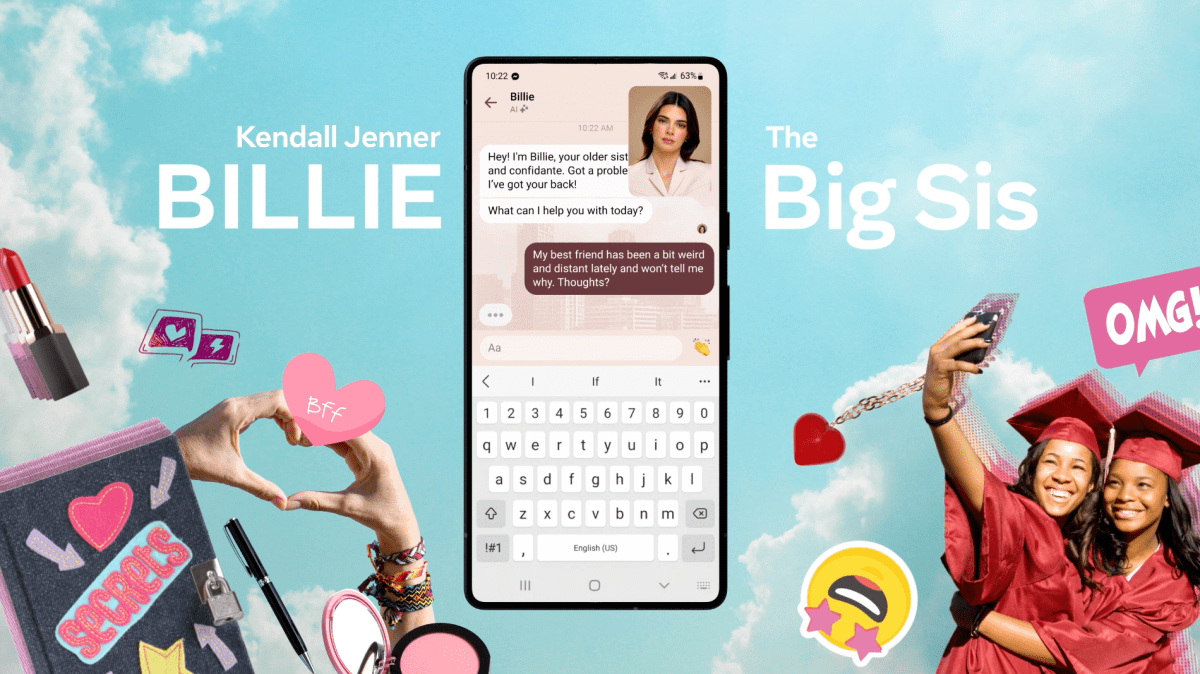

Cada personalidad de IA se basa en una celebridad o persona influyente real. Créditos de imagen: Meta

Meta eliminó 28 personajes de personalidad de IA que se basan en personajes famosos, pero creados completamente a partir de IA, de todos los mundos de los deportes, la música, las redes sociales y más. Puedes considerarlos como chatbots de temas específicos a los que puedes enviar mensajes en WhatsApp, Messenger e Instagram. Cada personalidad se basa en una celebridad o influencer. Por ejemplo:

La imagen de la estrella del fútbol Tom Brady se está utilizando para un personaje llamado “Bru” que puede hablarte sobre deportes. Naomi Osaka, una tenista, aparece como “Tamika” para hablar de todo lo relacionado con Manga. La personalidad de YouTube, Mr Beast, está interpretando a “Zach” para ser un… ¿tipo divertido? El luchador de MMA Israel Adesanya se presenta como Luiz para hablar sobre MMA. La modelo Kendall Jenner aparece como “Billie” para interpretar el papel de una hermana mayor.

Las IA de Meta se construyeron en Llama 2 LLM. La mayoría de sus bases de conocimiento se limitan a información que existía en gran medida antes de 2023, pero Meta dice que espera llevar su función de búsqueda Bing a sus IA en los próximos meses.

Los personajes no solo responderán mediante mensajes de texto: también podrán hablar el próximo año. Pero por ahora no hay audio. Cualquier elemento de vídeo que vea hoy y en el futuro se basa en animaciones generadas por IA. Meta filmó a las personas que representaban las diferentes IA y luego utilizó “técnicas generativas” para convertir esas animaciones dispares en una experiencia cohesiva.

Meta no quiso aclarar a TechCrunch cómo compensó a las celebridades por el uso de sus imágenes.

AI Studio para empresas y creadores

El estudio de IA de Meta está disponible para empresas y creadores. Presentando: Angela Fan, científica investigadora. Créditos de imagen: Meta

La plataforma AI Studio de Meta permitirá a las empresas crear chatbots de IA para los diversos servicios de mensajería de la empresa, incluidos Facebook, Instagram y Messenger.

Comenzando con Messenger, AI Studio permitirá a las empresas “crear IA que reflejen los valores de su marca y mejoren las experiencias de servicio al cliente”, escribe Meta en un correo. En el escenario, el director ejecutivo de Meta, Mark Zuckerberg, aclaró que los casos de uso que Meta imagina son principalmente el comercio electrónico y la atención al cliente.

AI Studio estará disponible en versión alfa para comenzar, y Meta dice que escalará aún más el conjunto de herramientas a partir del próximo año.

En el futuro, los creadores también podrán aprovechar AI Studio para crear IA que “extiendan su presencia virtual” en las aplicaciones de Meta. Meta señaló que estos tendrían que ser sancionados por el creador y controlados directamente por él.

El próximo año, Meta construirá una caja de arena para que cualquiera pueda experimentar creando su propia IA, algo que Meta traerá al metaverso.

Pegatinas de IA, impulsadas por Emu

Créditos de imagen: Meta

El CEO Mark Zuckerberg anunció que las pegatinas de IA generativa llegarían a las aplicaciones de mensajería de Meta. La función, que se basa en su nuevo modelo fundamental para la generación de imágenes, Emúpermitirá a los usuarios crear pegatinas de IA únicas en cuestión de segundos en metaaplicaciones, incluidas WhatsApp, Messenger, Instagram e incluso Facebook Stories.

“Todos los días la gente envía cientos de millones de stickers para expresar cosas en los chats”, dijo Zuckerberg. “Y cada chat es un poco diferente y quieres expresar emociones sutilmente diferentes. Pero hoy sólo tenemos un número fijo, pero con Emu ahora tienes la posibilidad de escribir lo que quieras”, dijo.

Para usar las pegatinas, puede escribir en un cuadro de texto exactamente qué tipo de imágenes desea ver. La función se demostró en WhatsApp, donde Zuckerberg mostró ideas locas como “perro pastor húngaro conduciendo un 4×4”, por ejemplo. Meta dice que se necesitan tres segundos en promedio para generar múltiples opciones para compartir al instante.

La función estará inicialmente disponible para usuarios de habla inglesa y comenzará a implementarse durante el próximo mes, afirma la compañía.

Edición de imágenes con IA: cambie el estilo de las fotos y agregue un fondo

Créditos de imagen: Meta

Meta dice que pronto podrás transformar tus imágenes o co-crear imágenes generadas por IA con amigos. Estas dos nuevas características (cambio de estilo y fondo) llegarán pronto a Instagram en los EE. UU., también impulsadas por la tecnología de Emu.

Restyle te permite reimaginar los estilos visuales de una imagen (Zuckerberg hizo una demostración de ediciones en una foto de su perro, Beast, donde usó IA para convertirla en estilos de origami y punto de cruz) escribiendo mensajes como “acuarela” o incluso un estilo más. mensaje detallado como “collage de revistas y periódicos, bordes rasgados”, explicó Meta en una publicación de blog.

Mientras tanto, el fondo cambia la escena o el fondo de la imagen mediante indicaciones.

Meta dice que las imágenes de IA indicarán el uso de IA “para reducir las posibilidades de que las personas las confundan con contenido generado por humanos”. La compañía dijo que también está experimentando con formas de marcadores visibles e invisibles.

Unas palabras sobre seguridad

“Si pasaste algún tiempo jugando con la IA conversacional, como probablemente sepas, tienen el potencial de decir cosas que son inexactas o incluso inapropiadas. Y eso también puede suceder con el nuestro”, afirmó Al-Dahle.

Al-Dahle describió en el escenario las “miles de horas” de formar equipos rojos y trabajar con indicaciones para entrenar a su asistente de inteligencia artificial y a sus personajes para mantenerse alejados de temas dudosos. El equipo rojo es un proceso iterativo en el que se intenta que el modelo diga cosas dañinas, aplique correcciones y repita. Continuamente.

Meta dice que también está lanzando tarjetas de sistema junto con sus IA para que la gente pueda entender “qué hay dentro y cómo se construyeron”.