A principios de la década de 2000, VMware presentó al mundo los servidores virtuales que permitieron a TI hacer un uso más eficiente de la capacidad del servidor inactivo. Hoy, Run: AI presenta ese mismo concepto a las GPU que ejecutan proyectos de aprendizaje automático en contenedores en Kubernetes.

Esto debería permitir que los equipos de ciencia de datos tengan acceso a más recursos de los que normalmente obtendrían si simplemente asignaran un cierto número de GPU disponibles. El CEO y cofundador de la compañía, Omri Geller, dice que su compañía cree que parte del problema para llevar los proyectos de IA al mercado se debe a la asignación estática de recursos que frena a los equipos de ciencia de datos.

“Hay muchas ocasiones en que esas fuentes informáticas importantes y costosas están inactivas, mientras que al mismo tiempo, otros usuarios pueden necesitar más potencia de cómputo ya que necesitan realizar más experimentos y no tienen acceso a los recursos disponibles porque son parte de una tarea estática ”, explicó Geller.

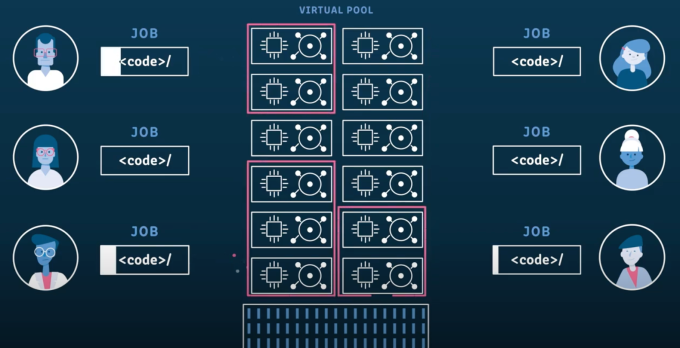

Para resolver ese problema de asignación de recursos estáticos, Ejecute: AI se le ocurrió una solución para virtualizar esos recursos de GPU, ya sea en prem o en la nube, y dejar que TI defina por política cómo deben dividirse esos recursos.

“Existe la necesidad de un enfoque de virtualización específico para la inteligencia artificial y la gestión y programación activa de esos recursos de GPU, al tiempo que proporciona la visibilidad y el control sobre esos recursos informáticos a las organizaciones de TI y los administradores de inteligencia artificial”, dijo.

Ejecutar: AI crea un grupo de recursos, que asigna según la necesidad. Ejecución de créditos de imagen: AI

Ejecutar: AI creó una solución para cerrar esta brecha entre los recursos que TI está brindando a los equipos de ciencia de datos y lo que requieren para ejecutar un trabajo determinado, al tiempo que le da a TI cierto control sobre la definición de cómo funciona.

“Realmente ayudamos a las empresas a sacar mucho más provecho de su infraestructura, y lo hacemos abstrayendo realmente el hardware de la ciencia de datos, lo que significa que simplemente puede ejecutar su experimento sin pensar en el hardware subyacente, y en cualquier momento puede consumir tanta potencia de cálculo como sea necesaria ”, dijo.

Si bien la compañía aún se encuentra en sus primeras etapas, y la situación económica actual está afectando a todos, Geller ve un lugar para una solución como Run: AI porque brinda a los clientes la capacidad de aprovechar al máximo los recursos existentes, al tiempo que hace ciencia de datos los equipos corren más eficientemente.

También está tomando una visión realista a largo plazo cuando se trata de la adquisición de clientes durante este tiempo. “Estos son tiempos difíciles para todos”, dice. “Tenemos planes para asociaciones a largo plazo con nuestros clientes que no están optimizados para ingresos a corto plazo”.

Run: AI fue fundada en 2018. Ha recaudado $ 13 millones, según Geller. La compañía tiene su sede en Israel con oficinas en los Estados Unidos. Actualmente tiene 25 empleados y unas pocas docenas de clientes.