Un grupo revelador de correos electrónicos revisados por Business Insider y Channel 4 ofrece un vistazo al proceso bastante caótico de cómo Facebook decide qué contenido cruza la línea. En este caso, un grupo de ejecutivos de Facebook participó en la determinación de si una publicación de Instagram del teórico de la conspiración Alex Jones violó los estándares comunitarios de la plataforma.

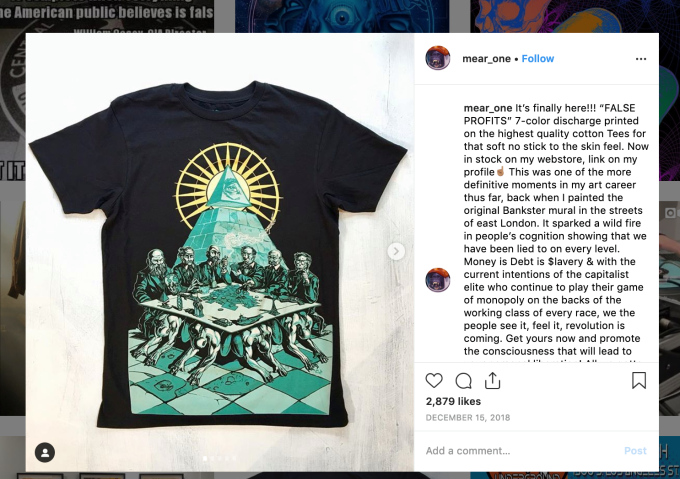

Para hacer esa determinación, 20 de Facebook e Instagram. los ejecutivos lo repartieron en el post de Jones, que mostraba un mural conocido como "False Profits" por el artista Mear One. Facebook comenzó a debatir la publicación luego de que fue señalada por Business Insider por lanzar comentarios antisemitas el miércoles.

La compañía eliminó 23 de 500 comentarios en la publicación que interpretó como una clara violación de la política de Facebook. Más adelante en la conversación, algunos de los ejecutivos de Instagram y Facebook con sede en el Reino Unido proporcionaron más contexto para sus pares de EE. UU.

El año pasado, surgió una controversia sobre la misma pintura cuando el político británico Jeremy Corbyn argumentó en apoyo del creador del mural después de que el arte fuera retirado de una pared en el este de Londres debido a lo que muchos creían que eran matices antisemitas. Debido a eso, la imagen y su contexto probablemente sean más conocidos en el Reino Unido, un hecho que surgió en la discusión de Facebook sobre cómo manejar la publicación de Jones.

"Esta imagen es ampliamente reconocida como antisemita y es una imagen famosa en el Reino Unido debido a la controversia pública que la rodea", dijo un ejecutivo. "Si regresamos y decimos que no viola, recibiremos muchas críticas".

En última instancia, después de algunos de ida y vuelta, el mensaje fue eliminado.

Según los correos electrónicos, Alex Jones ' Cuenta de Instagram "no viola actualmente [the rules]"Como" una cuenta de IG debe tener al menos un 30% de contenido violado en un momento dado según nuestras pautas habituales ". Este hecho podría resultar desconcertante una vez que sepas que Alex Jones consiguió que su cuenta principal se eliminara de Facebook en 2018, y La compañía hizo otro barrido para las páginas vinculadas a Jones el mes pasado.

Ya sea que esté de acuerdo con las decisiones de moderación de contenido de Facebook o no, es imposible argumentar que se aplican constantemente. En el último ejemplo, la compañía discutió sobre una representación única de una imagen controvertida, incluso cuando la misma imagen está literalmente a la venta por el artista en cualquier parte, tanto en Instagram como en Facebook. (Como cualquier reportero de Facebook puede atestiguar, estas inconsistencias probablemente se resolverán poco después de que esta historia se publique).

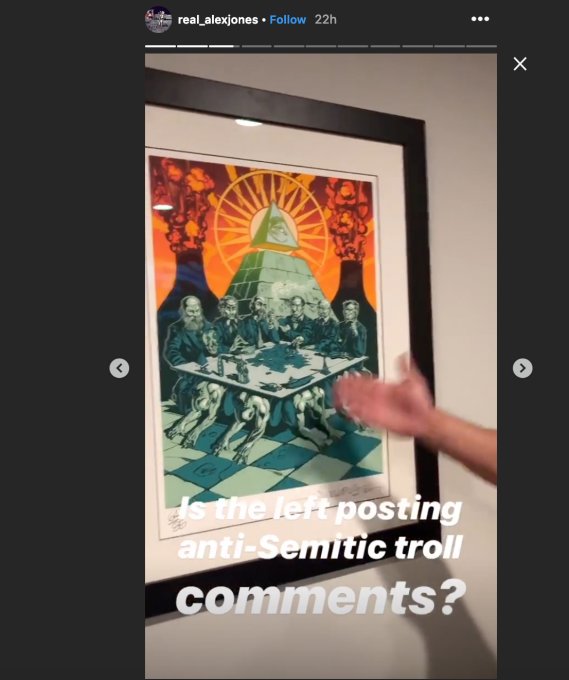

El propio artista vende su imagen en una camiseta tanto en Instagram como en Facebook, y numerosas descripciones de la misma imagen aparecen en varios hashtags. E incluso después de que se retiró la publicación, Jones la mostró de manera prominente en su historia de Instagram, declarando que la imagen "es solo sobre hombres de monopolio y la lucha de clases" y denuncia la "censura de locos niveles" de Facebook.

Está claro que incluso cuando Facebook intenta avanzar, su enfoque hacia la moderación del contenido sigue siendo reactivo, al azar y probablemente demasiado preocupado por la percepción pública. Algunos casos de contenido controvertido se escalan hasta la cima mientras que otros languidecen sin ser detectados. Donde se dibuja la línea no es particularmente claro. E incluso cuando se determinan violaciones de alto perfil, no es aparente que los estudios de casos que se filtran de manera significativa clarifiquen decisiones más pequeñas y cotidianas de los moderadores de contenido en los peldaños más bajos de Facebook.

Como siempre, la rueda chirriante obtiene la grasa, pero dos mil millones de usuarios y una aplicación de políticas reactiva en lugar de una política proactiva significan que hay un mar interminable de ruedas sin engrasar a la deriva. Este problema no es exclusivo de Facebook, pero dado su alcance, hace el mayor estudio de caso de lo que puede salir mal cuando una plataforma se amplía enormemente sin tener en cuenta las consecuencias.

Desafortunadamente para Facebook, es otra situación de pérdida-pérdida de su propia creación. Durante su intenso e intenso crecimiento acelerado, Facebook permitió que florecieran todo tipo de contenido potencialmente controversial y peligroso durante años. Ahora, cuando la compañía toma medidas enérgicas contra las cuentas que violan sus políticas de larga data que prohíben el discurso de odio, figuras divisivas como Alex Jones pueden llorar la censura, lo que hace que cientos de miles de seguidores sigan avanzando en el proceso.

Al igual que otras compañías tecnológicas, Facebook ahora está pagando mucho por los años sin preocupaciones que disfrutó antes de someterse a un intenso escrutinio por los efectos secundarios tóxicos de todo eso. crecimiento. Y hasta que Facebook desarrolle una interpretación más uniforme de los estándares de su propia comunidad, una que la compañía impone desde abajo hacia arriba en lugar de hacerlo desde arriba hacia abajo, va a seguir afectando a todos.