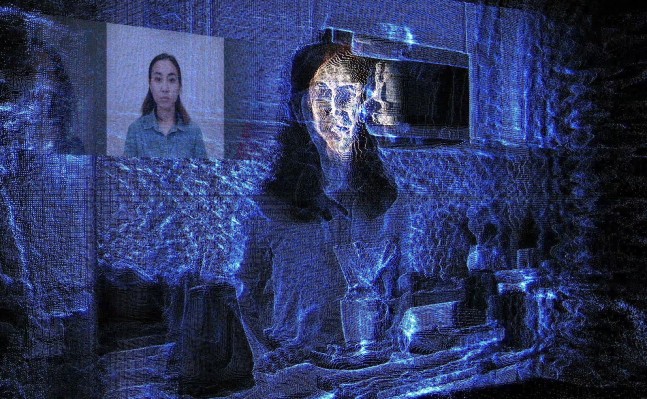

La manipulación de imágenes y videos impulsada por el aprendizaje profundo, o los llamados "deepfakes", representan una faceta extraña y horrible de un nuevo campo prometedor. Si vamos a tomar medidas enérgicas contra estas creaciones espeluznantes, tendremos que luchar contra el fuego con fuego; Facebook, Microsoft y muchos otros se están uniendo para ayudar a que el aprendizaje automático sea capaz de detectar falsificaciones profundas, y quieren que tú ayudes.

Aunque el fenómeno aún es nuevo, estamos en una carrera armamentista donde los métodos de detección compiten con los métodos de creación. Las falsificaciones cada vez más convincentes aparecen regularmente, y aunque a menudo son benignas, existe la posibilidad de que tu cara se injerte sin problemas en una posición comprometedora, y muchas celebridades ya se lo han hecho.

Facebook, como parte de una coalición con Microsoft, la Asociación para la IA y varias universidades, incluidas Oxford, Berkeley y MIT, está trabajando para potenciar el lado del bien con mejores técnicas de detección.

"Los avances más interesantes en IA se produjeron cuando hay un punto de referencia claro en un conjunto de datos contra el cual escribir documentos", dijo ayer el CTO de Facebook, Mike Schroepfer, en una llamada a los medios. El conjunto de datos para el reconocimiento de objetos podría ser millones de imágenes de objetos ordinarios, mientras que el conjunto de datos para la transcripción de voz sería horas de diferentes tipos de discurso. Pero no existe tal conjunto para las falsificaciones profundas.

Hablamos sobre este desafío en nuestro evento de Robótica e IA a principios de este año en lo que pensé que era una discusión muy interesante:

Afortunadamente, Facebook planea dedicar alrededor de $ 10 millones en recursos para hacer que este Deepfake Detection Challenge suceda.

"La creación de estos conjuntos de datos puede ser un desafío, porque desea asegurarse de que todos los que participen en ella sean claros y den su consentimiento para que no se sorprendan por su uso", continuó Schroepfer. Y dado que la mayoría de las falsificaciones profundas se realizan sin ningún tipo de consentimiento, no se permite su uso en un contexto académico.

Entonces, Facebook y sus socios están haciendo que el contenido falso sea de tela entera, dijo. “Desea un conjunto de datos de video fuente, y luego un conjunto de datos de personalidades que pueda asignar a eso. Luego, dedicamos tiempo de ingeniería a la implementación de las técnicas más avanzadas de deepfake para generar videos alterados como parte del conjunto de datos ".

Y aunque está completamente justificado en preguntarse, no, no están usando datos de Facebook para hacer esto. Tienen actores pagados.

Source link