El principal regulador de protección de datos del Reino Unido ha advertido sobre el uso imprudente e inapropiado del reconocimiento facial en vivo (LFR) en lugares públicos.

Publicar un opinión hoy sobre el uso de esta vigilancia biométrica en público, para establecer lo que se denomina las “reglas de participación”, la comisionada de información, Elizabeth Denham, también señaló que varias investigaciones ya realizadas por su oficina sobre las aplicaciones planificadas de la tecnología han Encontrado problemas en todos los casos.

“Estoy profundamente preocupado por la posibilidad de que la tecnología de reconocimiento facial en vivo (LFR) se utilice de manera inapropiada, excesiva o incluso imprudente. Cuando se recopilan datos personales confidenciales a escala masiva sin el conocimiento, la elección o el control de las personas, los impactos podrían ser significativos ”, advirtió en un entrada en el blog.

“Los usos que hemos visto incluyeron abordar las preocupaciones de seguridad pública y crear perfiles biométricos para dirigirse a las personas con publicidad personalizada.

“Es revelador que ninguna de las organizaciones involucradas en nuestras investigaciones completadas pudo justificar completamente el procesamiento y, de los sistemas que se pusieron en funcionamiento, ninguno cumplió completamente con los requisitos de la ley de protección de datos. Todas las organizaciones optaron por detener o no continuar con el uso de LFR “.

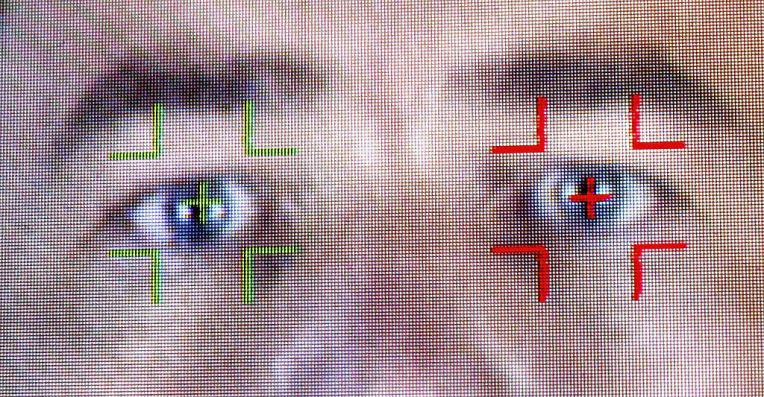

“A diferencia de CCTV, LFR y sus algoritmos pueden identificar automáticamente quién es usted e inferir detalles confidenciales sobre usted. Se puede usar para perfilarlo instantáneamente para ofrecer anuncios personalizados o comparar su imagen con ladrones conocidos mientras hace su compra semanal ”, agregó Denham.

“En el futuro, existe la posibilidad de superponer cámaras CCTV con LFR, e incluso combinarlo con datos de redes sociales u otros sistemas de ‘Big Data’: LFR es CCTV sobrealimentado”.

El uso de tecnologías biométricas para identificar a las personas de forma remota genera importantes preocupaciones en materia de derechos humanos, incluida la privacidad y el riesgo de discriminación.

En toda Europa hay campañas, como Recupera tu rostro – pidiendo la prohibición de la vigilancia biométrica masiva.

En otra acción dirigida, en mayo, Privacy International y otros presentaron desafíos legales en la controvertida empresa estadounidense de reconocimiento facial, Clearview AI, con el fin de evitar que opere en Europa por completo. (Algunas fuerzas policiales regionales han estado interviniendo, incluso en Suecia, donde la DPA nacional multó a la fuerza a principios de este año por uso ilegal de la tecnología).

Pero si bien existe una gran oposición pública a la vigilancia biométrica en Europa, los legisladores de la región hasta ahora, en el mejor de los casos, han estado manipulando los bordes del controvertido tema.

Un reglamento paneuropeo que la Comisión Europea presentó en abril, que propone un marco basado en el riesgo para las aplicaciones de inteligencia artificial, incluía solo una prohibición parcial del uso de vigilancia biométrica en lugares públicos por parte de las fuerzas del orden, con amplias exenciones que han atraído a muchos crítica.

También ha habido llamamientos para la prohibición total del uso de tecnologías como el reconocimiento facial en vivo en público por parte de los eurodiputados de todo el espectro político. El supervisor jefe de protección de datos de la UE también ha instado a los legisladores a prohibir al menos temporalmente el uso de la vigilancia biométrica en público.

En cualquier caso, el Reglamento de IA previsto por la UE no se aplicará en el Reino Unido, ya que el país ahora está fuera del bloque. Y queda por ver si el gobierno del Reino Unido buscará debilitar el régimen nacional de protección de datos.

Un reciente reporte se encargó de examinar cómo el Reino Unido podría revisar su régimen regulatorio, después del Brexit, por ejemplo, sugirió reemplazar el RGPD del Reino Unido con un nuevo “marco del Reino Unido”, proponiendo cambios para “liberar datos para la innovación y el interés público” , como dice, y abogando por revisiones para la IA y los “sectores de crecimiento”. Por lo tanto, si el régimen de protección de datos del Reino Unido será incendiado en una hoguera de “burocracia” posterior al Brexit es una preocupación clave para los observadores de derechos.

(El informe del Grupo de Trabajo sobre Innovación, Crecimiento y Reforma Regulatoria aboga, por ejemplo, por la eliminación completa del Artículo 22 del GDPR, que otorga a las personas el derecho a no estar sujetas a decisiones basadas únicamente en el procesamiento automatizado, sugiriendo que se reemplace por “a centrarse ”en“ si la elaboración de perfiles automatizada cumple con una prueba de interés público o legítimo ”, con orientación sobre la que se prevé que provenga de la Oficina del Comisionado de Información (ICO). Pero también debe tenerse en cuenta que el gobierno está en proceso de contratar al sucesor de Denham; y el ministro digital ha dicho quiere que su reemplazo adopte “un nuevo enfoque audaz” que “ya no vea los datos como una amenaza, sino como la gran oportunidad de nuestro tiempo”. Entonces, ¿adiós a la justicia, la responsabilidad y la transparencia entonces?)

Por ahora, aquellos que buscan implementar LFR en el Reino Unido deben cumplir con las disposiciones de la Ley de Protección de Datos del Reino Unido de 2018 y el Reglamento General de Protección de Datos del Reino Unido (también conocido como su implementación del RGPD de la UE que se transpuso a la ley nacional antes del Brexit), según el Opinión de la ICO, incluidos los principios de protección de datos establecidos en el artículo 5 del RGPD del Reino Unido, incluida la legalidad, la equidad, la transparencia, la limitación del propósito, la minimización de datos, la limitación de almacenamiento, la seguridad y la responsabilidad.

Los controladores también deben permitir que las personas ejerzan sus derechos, dijo también el dictamen.

“Las organizaciones deberán demostrar altos estándares de gobernanza y responsabilidad desde el principio, incluida la posibilidad de justificar que el uso de LFR es justo, necesario y proporcionado en cada contexto específico en el que se implementa. Necesitan demostrar que las técnicas menos intrusivas no funcionarán ”, escribió Denham. “Estos son estándares importantes que requieren una evaluación sólida.

“Las organizaciones también deberán comprender y evaluar los riesgos de usar una tecnología potencialmente intrusiva y su impacto en la privacidad de las personas y sus vidas. Por ejemplo, cómo los problemas relacionados con la precisión y el sesgo pueden provocar una identificación errónea y el daño o perjuicio que conlleva “.

El momento de la publicación de la opinión de la ICO sobre LFR es interesante a la luz de preocupaciones más amplias sobre la dirección de los viajes en el Reino Unido en materia de protección de datos y privacidad.

Si, por ejemplo, el gobierno tiene la intención de contratar a un nuevo comisionado de información ‘más flexible’, que felizmente romperá el libro de reglas sobre protección de datos e IA, incluso en áreas como la vigilancia biométrica, al menos será bastante incómodo para ellos. Hágalo con una opinión del comisionado anterior sobre el registro público que detalle los peligros del uso imprudente e inapropiado de LFR.

Ciertamente, el próximo comisionado de información no podrá decir que no recibió una advertencia clara de que los datos biométricos son particularmente sensibles y pueden usarse para estimar o inferir otras características, como su edad, sexo, género o etnia.

O que los tribunales de la “Gran Bretaña” han concluido anteriormente que “como las huellas dactilares y el ADN [a facial biometric template] es información de carácter ‘intrínsecamente privado’ ”, como señala la opinión de ICO, al tiempo que subraya que LFR puede hacer que estos datos súper sensibles se recopilen sin que la persona en cuestión se dé cuenta de lo que está sucediendo.

La opinión de Denham también incide en la necesidad de la confianza del público para que cualquier tecnología tenga éxito, advirtiendo que: “El público debe tener confianza en que su uso es legal, justo, transparente y cumple con los demás estándares establecidos en protección de datos. legislación.”

El ICO ha publicado previamente un Opinión sobre el uso de LFR por las fuerzas policiales – que, dijo, también establece “un umbral alto para su uso”. (Y algunas fuerzas policiales del Reino Unido, incluido el Met en Londres, han estado entre los primeros en adoptar la tecnología de reconocimiento facial, lo que a su vez ha llevado a algunos a agua caliente legal en temas como el sesgo).

Sin embargo, lamentablemente para los defensores de los derechos humanos, la opinión de la ICO evita recomendar una prohibición total del uso de la vigilancia biométrica en público por parte de empresas privadas u organizaciones públicas, y el comisionado argumentó que si bien existen riesgos con el uso de la tecnología, podrían También habrá casos en los que tenga una gran utilidad (como en la búsqueda de un niño desaparecido).

“No es mi papel respaldar o prohibir una tecnología, pero, aunque esta tecnología se está desarrollando y no se está implementando ampliamente, tenemos la oportunidad de asegurarnos de que no se expanda sin tener en cuenta la protección de datos”, escribió, diciendo en cambio que en su ver “la protección de datos y la privacidad de las personas deben estar en el centro de cualquier decisión para implementar LFR”.

Denham agregó que la ley (actual) del Reino Unido “establece un listón muy alto para justificar el uso de LFR y sus algoritmos en lugares donde compramos, socializamos o nos reunimos”.

“Con cualquier nueva tecnología, generar confianza pública y seguridad en la forma en que se usa la información de las personas es crucial para que los beneficios derivados de la tecnología se puedan realizar plenamente”, reiteró, y señaló cómo la falta de confianza en los EE. UU. Ha llevado a algunas ciudades prohibir el uso de LFR en ciertos contextos y llevó a algunas empresas a detener los servicios hasta que las reglas sean más claras.

“Sin confianza, se pierden los beneficios que la tecnología puede ofrecer”, advirtió también.

Hay una línea roja que el gobierno del Reino Unido puede estar olvidando en su indecorosa prisa por destripar (potencialmente) el régimen de protección de datos del Reino Unido en nombre de una “innovación” engañosa. Porque si intenta, eh, ‘liberar’ las normas nacionales de protección de datos de los principios básicos de la UE (de legalidad, equidad, proporcionalidad, transparencia, responsabilidad, etc.), corre el riesgo de salirse de la alineación normativa con la UE, lo que obligaría a la Comisión Europea para romper un acuerdo de adecuación de datos UE-Reino Unido (en el que el la tinta aún se está secando).

El Reino Unido que tiene un acuerdo de adecuación de datos de la UE depende de que el Reino Unido tenga protecciones esencialmente equivalentes para los datos de las personas. Sin este codiciado estado de adecuación de los datos, las empresas del Reino Unido se enfrentarán de inmediato a obstáculos legales mucho mayores para procesar los datos de los ciudadanos de la UE (como lo hace ahora Estados Unidos, tras la desaparición de Safe Harbor y Privacy Shield). Incluso podría haber situaciones en las que las agencias de protección de datos de la UE ordenen la suspensión total de los flujos de datos entre la UE y el Reino Unido …

Obviamente, tal escenario sería terrible para las empresas y la “innovación” del Reino Unido, incluso antes de considerar el tema más amplio de la confianza pública en las tecnologías y si el gran público británico quiere que se incendien sus derechos de privacidad.

Teniendo en cuenta todo esto, realmente hay que preguntarse si alguien dentro del gobierno del Reino Unido ha pensado bien en este asunto de la “reforma regulatoria”. Por ahora, la ICO al menos todavía es capaz de pensar por ellos.