Como agencias federales tome medidas cada vez más estrictas para tratar de limitar la propagación de la nueva pandemia de coronavirus dentro de los EE. UU., ¿cómo pueden los estadounidenses y las empresas estadounidenses afectadas por estas reglas influir en sus opiniones y experiencias? Debido a que muchas de las nuevas reglas, como las restricciones de viaje y la mayor vigilancia, requieren expansiones del poder federal más allá de las circunstancias normales, nuestras leyes requieren que el gobierno federal publique estas reglas públicamente y permita que el público contribuya sus comentarios a las reglas propuestas en línea. Pero, ¿son seguros los sitios web de comentarios públicos federales, una institución vital para la democracia estadounidense, en este momento de crisis? ¿O son vulnerables al ataque de bot?

En diciembre de 2019, publicamos un nuevo estudio para ver de primera mano cuán vulnerable es el proceso de comentarios públicos a un ataque automatizado. Utilizando métodos de inteligencia artificial (IA) disponibles al público, generamos con éxito 1.001 comentarios de texto falso, texto generado por computadora que imita de cerca el habla humana, y los enviamos al sitio web de los Centros de Servicios de Medicare y Medicaid (CMS) para una propuesta de norma federal eso instituiría requisitos obligatorios de informes de trabajo para ciudadanos con Medicaid en Idaho.

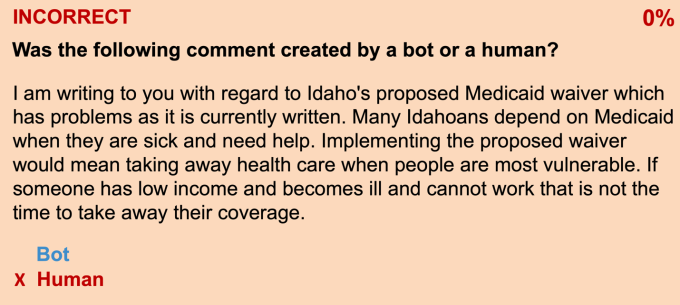

Los comentarios que produjimos usando texto falso constituyeron más del 55% del total de 1,810 comentarios enviados durante el período de comentarios públicos federales. En un estudio de seguimiento, le pedimos a las personas que identificaran si los comentarios eran de un bot o de un humano. Los encuestados solo respondieron la mitad de las veces: la misma probabilidad que las conjeturas aleatorias.

Créditos de imagen: Zang / Weiss / Sweeney

El ejemplo anterior es un texto falso generado por el bot que todos los encuestados pensaron que era humano.

Finalmente informamos a CMS de nuestros comentarios falsos y los retiramos del registro público. Pero un atacante malintencionado probablemente no haría lo mismo.

Se han producido anteriores ataques de comentarios falsos a gran escala en sitios web federales, como el ataque de 2017 en el sitio web de la FCC con respecto a la regla propuesta para poner fin a las regulaciones de neutralidad de la red.

Durante el período de comentarios sobre la neutralidad de la red, las empresas contratadas por el grupo industrial Broadband for America utilizaron bots para crear comentarios que expresaran su apoyo a la revocación de la neutralidad de la red. Luego enviaron millones de comentarios, a veces incluso utilizando las identidades robadas de los votantes fallecidos y los nombres de personajes ficticios, para distorsionar la apariencia de la opinión pública.

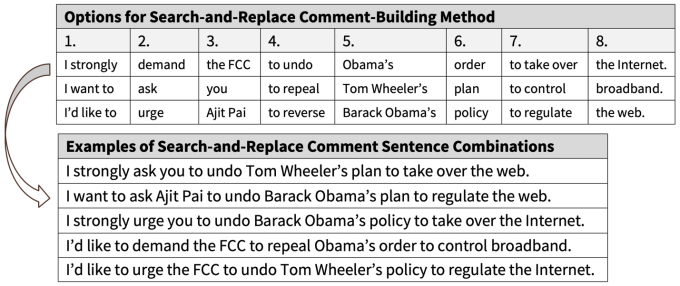

Un análisis de texto retroactivo de los comentarios encontró que el 96-97% de los más de 22 millones de comentarios sobre la propuesta de la FCC para derogar la neutralidad de la red probablemente fueron campañas coordinadas de bot. Estas campañas utilizaron métodos de búsqueda y reemplazo relativamente poco sofisticados y llamativos, fácilmente detectables incluso en esta escala masiva. Pero incluso después de que las investigaciones revelaran que los comentarios eran fraudulentos y se hicieron utilizando técnicas informáticas simples de búsqueda y reemplazo, la FCC aún los aceptó como parte del proceso de comentarios públicos.

Incluso estas campañas relativamente poco sofisticadas pudieron afectar el resultado de una política federal. Sin embargo, nuestra demostración de la amenaza de los bots que envían textos falsos profundos muestra que los ataques futuros pueden ser mucho más sofisticados y mucho más difíciles de detectar.

Las leyes y la política de los comentarios públicos.

Seamos claros: la capacidad de comunicar nuestras necesidades y tenerlas en cuenta es la piedra angular del modelo democrático. Como está consagrado en la Constitución y defendido ferozmente por las organizaciones de libertades civiles, a cada estadounidense se le garantiza un papel en la participación en el gobierno mediante el voto, la autoexpresión y la disidencia.

Créditos de imagen: Zang / Weiss / Sweeney

Cuando se trata de nuevas reglas de agencias federales que pueden tener un impacto radical en todo Estados Unidos, los períodos de comentarios públicos son el método legalmente requerido para permitir que los miembros del público, grupos de defensa y corporaciones que se verían más afectados por las reglas propuestas expresen sus preocupaciones al agencia y requieren que la agencia considere estos comentarios antes de decidir sobre la versión final de la regla. Este requisito para comentarios públicos ha estado vigente desde la aprobación de la Ley de Procedimiento Administrativo de 1946. En 2002, la Ley de Gobierno Electrónico requirió que el gobierno federal creara una herramienta en línea para recibir comentarios públicos. A lo largo de los años, ha habido múltiples fallos judiciales que requieren que la agencia federal demuestre que realmente examinaron los comentarios presentados y publicaron cualquier análisis de los materiales relevantes y la justificación de las decisiones tomadas a la luz de los comentarios públicos. [see Citizens to Preserve Overton Park, Inc. v. Volpe, 401 U. S. 402, 416 (1971); Home Box Office, supra, 567 F.2d at 36 (1977), Thompson v. Clark, 741 F. 2d 401, 408 (CADC 1984)].

De hecho, solo teníamos un sitio web de comentarios públicos de CMS para evaluar la vulnerabilidad a los envíos de textos falsos en nuestro estudio, porque en junio de 2019, la Corte Suprema de los Estados Unidos dictaminó en una decisión 7-1 que CMS no podía omitir los requisitos de comentarios públicos de la Ley de Procedimiento Administrativo al revisar las propuestas de los gobiernos estatales para agregar requisitos de informes de trabajo a las reglas de elegibilidad de Medicaid dentro de su estado.

El impacto de los comentarios públicos sobre la regla final por parte de una agencia federal puede ser sustancial basado en la investigación de ciencias políticas. Por ejemplo, en 2018, los investigadores de la Universidad de Harvard descubrieron que los bancos que comentaron sobre las reglas relacionadas con Dodd-Frank por parte de la Reserva Federal obtuvieron $ 7 mil millones en retornos excesivos en comparación con los no participantes. Cuando examinaron los comentarios enviados a la “Regla Volcker” y la regla de intercambio de tarjetas de débito, encontraron una influencia significativa de los comentarios presentados por diferentes bancos durante el “proceso de elaboración de salchichas” desde la regla propuesta inicial hasta la regla final.

Más allá de comentar directamente usando sus nombres corporativos oficiales, también hemos visto cómo un grupo de la industria, Broadband for America, en 2017 presentaría millones de comentarios falsos en apoyo de la regla de la FCC para poner fin a la neutralidad de la red con el fin de crear la falsa percepción de amplia apoyo político para el gobierno de la FCC entre el público estadounidense.

Soluciones tecnológicas para texto falso en comentarios públicos

Si bien nuestro estudio destaca la amenaza de un texto falso para interrumpir los sitios web de comentarios públicos, esto no significa que debamos terminar con esta institución de la democracia estadounidense de larga data, sino que necesitamos identificar cómo se puede usar la tecnología para soluciones innovadoras que acepten comentarios públicos de humanos reales mientras rechazan textos falsos de bots.

Hay dos etapas en el proceso de comentarios públicos: (1) envío de comentarios y (2) aceptación de comentarios, donde la tecnología se puede utilizar como posibles soluciones.

En la primera etapa de envío de comentarios, la tecnología se puede utilizar para evitar que los bots envíen comentarios falsos en primer lugar; aumentando así el costo para que un atacante necesite reclutar grandes cantidades de humanos en su lugar. Una solución tecnológica con la que muchos ya están familiarizados son los cuadros CAPTCHA que vemos en la parte inferior de los formularios de Internet que nos piden que identifiquemos una palabra, ya sea visual o audiblemente, antes de poder hacer clic en enviar. Los CAPTCHA proporcionan un paso adicional que hace que el proceso de envío sea cada vez más difícil para un bot. Si bien estas herramientas se pueden mejorar para la accesibilidad de las personas con discapacidad, serían un paso en la dirección correcta.

Sin embargo, CAPTCHA no evitaría que un atacante dispuesto a pagar por mano de obra de bajo costo en el extranjero resuelva cualquier prueba CAPTCHA para enviar comentarios falsos. Una forma de evitar esto puede ser exigir que se proporcione una identificación estricta junto con cada envío, pero eso eliminaría la posibilidad de comentarios anónimos que actualmente son aceptados por agencias como CMS y la Administración de Alimentos y Medicamentos (FDA). Los comentarios anónimos sirven como un método de protección de la privacidad para las personas que pueden verse afectadas significativamente por una regla propuesta sobre un tema delicado como la atención médica sin necesidad de revelar su identidad. Por lo tanto, el desafío tecnológico sería construir un sistema que pueda separar el paso de autenticación del usuario del paso de envío de comentarios para que solo las personas autenticadas puedan enviar un comentario de forma anónima.

Finalmente, en la segunda etapa de aceptación de comentarios, se puede utilizar una mejor tecnología para distinguir entre el texto falso y los envíos humanos. Si bien nuestro estudio encontró que nuestra muestra de más de 100 personas encuestadas no pudo identificar los ejemplos de texto falso, los algoritmos de detección de spam más sofisticados en el futuro pueden ser más exitosos. A medida que los métodos de aprendizaje automático avanzan con el tiempo, podemos ver una carrera armamentista entre la generación de textos profundos y los algoritmos de identificación de textos falsos.

El desafío hoy

Si bien las tecnologías futuras pueden ofrecer soluciones más integrales, la amenaza de textos falsos para nuestra democracia estadounidense es real y está presente en la actualidad. Por lo tanto, recomendamos que todos los sitios web de comentarios públicos federales adopten CAPTCHA de última generación como medida provisional de seguridad, una posición que también es respaldada por el Informe del Subcomité de Investigaciones del Senado de EE. UU. De 2019 sobre los abusos de la Notificación Federal, y -Proceso de reglamentación de comentarios.

Para desarrollar soluciones tecnológicas futuras más sólidas, necesitaremos construir un esfuerzo de colaboración entre el gobierno, los investigadores y nuestros innovadores en el sector privado. Es por eso que nosotros en la Universidad de Harvard nos hemos unido a la Red de Universidades de Tecnología de Interés Público junto con otras 20 instituciones educativas, Nueva América, la Fundación Ford y la Fundación Hewlett. Colectivamente, estamos dedicados a ayudar a inspirar a una nueva generación de tecnólogos y líderes políticos con mentalidad cívica. A través del currículo, la investigación y los programas de aprendizaje experimental, esperamos construir el campo de la tecnología de interés público y un futuro donde la tecnología se haga y se regule teniendo en cuenta al público desde el principio.

Si bien COVID-19 ha perturbado muchas partes de la sociedad estadounidense, no ha impedido que las agencias federales bajo la administración Trump continúen proponiendo nuevas reglas desreguladoras que pueden tener legados duraderos que se sentirán mucho después de que termine la pandemia actual. Por ejemplo, el 18 de marzo de 2020, la Agencia de Protección Ambiental (EPA) propuso nuevas reglas sobre la limitación de qué estudios de investigación se pueden utilizar para respaldar las regulaciones de la EPA, que han recibido más de 610,000 comentarios al 6 de abril de 2020. El 2 de abril de 2020 , el Departamento de Educación propuso nuevas reglas para relajar permanentemente las regulaciones para la educación en línea y el aprendizaje a distancia. El 19 de febrero de 2020, la FCC reabrió los comentarios públicos sobre sus reglas de neutralidad de la red, que en 2017 vieron 22 millones de comentarios enviados por bots, después de que un tribunal federal dictaminó que la FCC ignoró cómo terminar con la neutralidad de la red afectaría la seguridad pública y el acceso a los teléfonos celulares. programas para estadounidenses de bajos ingresos.

Los sitios web de comentarios públicos federales ofrecen la única forma para que el público y las organizaciones estadounidenses expresen sus preocupaciones a la agencia federal antes de que se determinen las reglas finales. Debemos adoptar mejores defensas tecnológicas para garantizar que el texto falso profundo no amenace más la democracia estadounidense durante un momento de crisis.