La IA es fundamental para muchos productos y servicios en la actualidad, pero su hambre de ciclos de datos y computación no tiene fondo. Lightmatter planea superar la ley de Moore con sus chips fotónicos ultrarrápidos especializados para el trabajo de inteligencia artificial, y con una nueva ronda de $ 80 millones, la compañía está lista para llevar su computación de potencia ligera al mercado.

Cubrimos Lightmatter por primera vez en 2018, cuando los fundadores acababan de salir del MIT y habían recaudado $ 11 millones para demostrar que su idea de la computación fotónica era tan valiosa como afirmaban. Pasaron los siguientes tres años y cambiaron la construcción y el perfeccionamiento de la tecnología, y se encontraron con todos los obstáculos que las startups de hardware y los fundadores técnicos tienden a encontrar.

Para obtener un desglose completo de lo que hace la tecnología de la compañía, lea esa característica: lo esencial no ha cambiado.

En pocas palabras, los chips de Lightmatter funcionan en un instante, literalmente, ciertos cálculos complejos fundamentales para el aprendizaje automático. En lugar de utilizar carga, puertas lógicas y transistores para registrar y manipular datos, los chips utilizan circuitos fotónicos que realizan los cálculos manipulando la trayectoria de la luz. Ha sido posible durante años, pero hasta hace poco conseguir que funcione a gran escala, y para un propósito práctico, de hecho, muy valioso, no lo ha hecho.

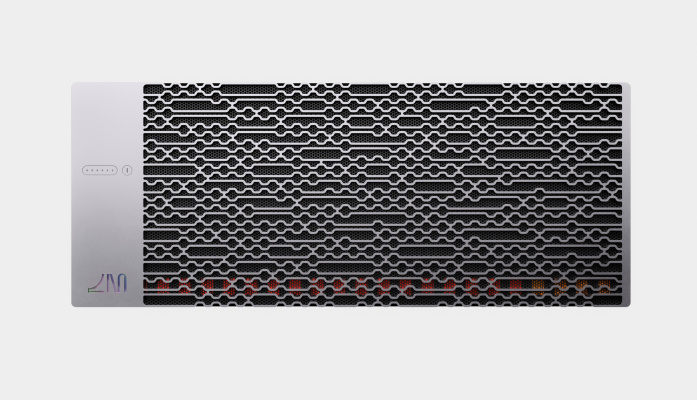

Prototipo de producto

En 2018, cuando Lightmatter estaba despegando, no estaba del todo claro si esta tecnología sería algo que pudieran vender para reemplazar los clústeres de cómputo más tradicionales, como las miles de unidades personalizadas que las empresas como Google y Amazon usan para entrenar sus IA.

“Sabíamos que, en principio, la tecnología debería ser excelente, pero había muchos detalles que necesitábamos resolver”, dijo el CEO y cofundador Nick Harris a TechCrunch en una entrevista. “Muchos desafíos teóricos de la informática y el diseño de chips que teníamos que superar … y COVID era una bestia”.

Con los proveedores fuera de servicio y muchos en la industria pausando asociaciones, retrasando proyectos y otras cosas, la pandemia retrasó el cronograma de Lightmatter meses, pero salieron del otro lado más fuertes. Harris dijo que los desafíos de construir una empresa de chips desde cero eran sustanciales, si no inesperados.

Créditos de imagen: Materia ligera

“En general, lo que estamos haciendo es una locura”, admitió. “Estamos construyendo computadoras de la nada. Diseñamos el chip, el paquete del chip, la tarjeta en la que se encuentra el paquete del chip, el sistema en el que entran las tarjetas y el software que se ejecuta en él…. hemos tenido que construir una empresa que abarque toda esta experiencia “.

Esa empresa ha pasado de ser un puñado de fundadores a más de 70 empleados en Mountain View y Boston, y el crecimiento continuará a medida que introduzca su nuevo producto en el mercado.

Donde hace unos años el producto de Lightmatter era más un brillo de ojos bien informado, ahora ha tomado una forma más sólida en el Envise, que ellos llaman un “acelerador de IA fotónico de propósito general”. Es una unidad de servidor diseñada para caber en racks normales de centros de datos, pero equipada con múltiples unidades de computación fotónica, que pueden realizar procesos de inferencia de redes neuronales a velocidades alucinantes. (Está limitado a ciertos tipos de cálculos, a saber, álgebra lineal por ahora, y no a lógica compleja, pero este tipo de matemáticas es un componente importante de los procesos de aprendizaje automático).

Harris se mostró reticente a proporcionar cifras exactas sobre las mejoras de rendimiento, pero más porque esas mejoras están aumentando que porque no son lo suficientemente impresionantes. El sitio web sugiere que es 5 veces más rápido que una unidad Nvidia A100 en un modelo de transformador grande como BERT, mientras utiliza aproximadamente el 15% de la energía. Eso hace que la plataforma sea doblemente atractiva para los gigantes de la inteligencia artificial con mucho dinero como Google y Amazon, que constantemente requieren más potencia de cómputo y pagan mucho por la energía necesaria para usarla. O un mejor rendimiento o un menor costo de energía serían excelentes; ambos juntos son irresistibles.

El plan inicial de Lightmatter es probar estas unidades con sus clientes más probables para fines de 2021, refinándolas y llevándolas a niveles de producción para que puedan venderse ampliamente. Pero Harris enfatizó que este era esencialmente el Modelo T de su nuevo enfoque.

“Si estamos en lo cierto, acabamos de inventar el próximo transistor”, dijo, y para los propósitos de la computación a gran escala, la afirmación no carece de mérito. No va a tener una computadora fotónica en miniatura en la mano en el corto plazo, pero en los centros de datos, donde se predice que llegará hasta el 10% de la energía del mundo para 2030, “realmente tienen un apetito ilimitado”.

El color de las matemáticas

Créditos de imagen: Materia ligera

Hay dos formas principales en las que Lightmatter planea mejorar las capacidades de sus computadoras fotónicas. El primero, y el que suena más loco, es el procesamiento en diferentes colores.

No es tan descabellado cuando piensas en cómo funcionan realmente estas computadoras. Los transistores, que han estado en el corazón de la informática durante décadas, utilizan electricidad para realizar operaciones lógicas, abrir y cerrar puertas, etc. A una escala macro, puede tener diferentes frecuencias de electricidad que pueden manipularse como formas de onda, pero a esta escala más pequeña no funciona así. Solo tiene una forma de moneda, los electrones y las puertas están abiertas o cerradas.

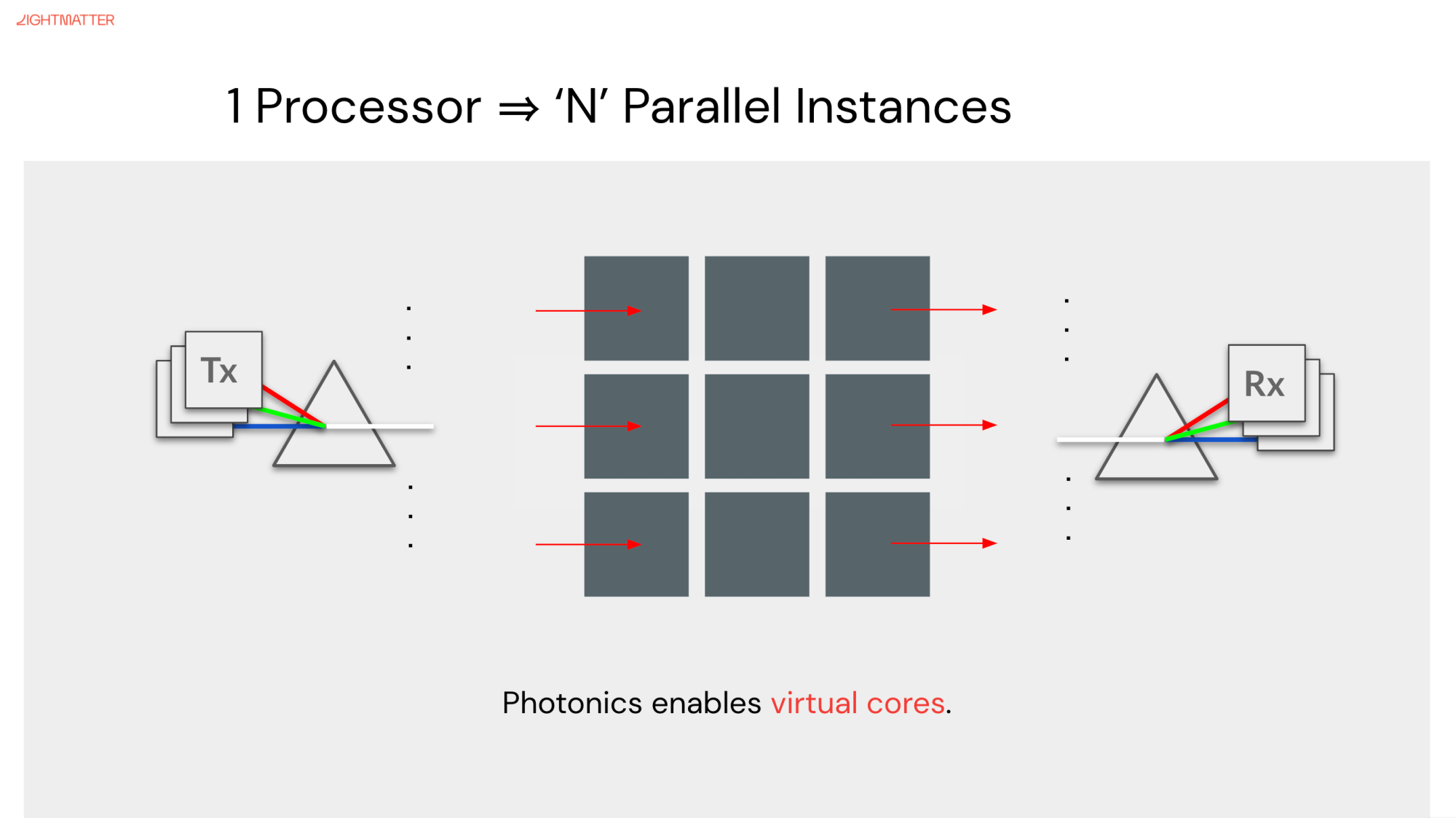

En los dispositivos de Lightmatter, sin embargo, la luz pasa a través de guías de ondas que realizan los cálculos a medida que avanza, simplificando (de alguna manera) y acelerando el proceso. Y la luz, como todos aprendimos en la clase de ciencias, viene en una variedad de longitudes de onda, todas las cuales pueden ser se utiliza de forma independiente y simultánea en el mismo hardware.

La misma magia óptica que permite que una señal enviada por un láser azul sea procesada a la velocidad de la luz funciona para un láser rojo o verde con una mínima modificación. Y si las ondas de luz no interfieren entre sí, pueden viajar a través de los mismos componentes ópticos al mismo tiempo sin perder coherencia.

Créditos de imagen: Materia ligera

Eso significa que si un chip Lightmatter puede hacer, digamos, un millón de cálculos por segundo usando una fuente de láser rojo, agregar otro color duplica eso a dos millones, agregar otro hace tres, con muy poca modificación necesaria. El principal obstáculo es conseguir láseres que estén a la altura, dijo Harris. Ser capaz de tomar aproximadamente el mismo hardware y duplicar, triplicar o 20 veces el rendimiento casi instantáneamente lo convierte en una buena hoja de ruta.

También conduce al segundo desafío en el que la empresa está trabajando para despejar, a saber interconectar. Cualquier supercomputadora se compone de muchas pequeñas computadoras individuales, miles y miles de ellas, trabajando en perfecta sincronía. Para que puedan hacerlo, necesitan comunicarse constantemente para asegurarse de que cada núcleo sepa lo que están haciendo los otros núcleos y, de lo contrario, coordinar los problemas informáticos inmensamente complejos para los que está diseñada la supercomputación. (Intel habla aquí sobre este problema de “concurrencia” al construir una supercomputadora a escala exa).

“Una de las cosas que hemos aprendido a lo largo del camino es, ¿cómo lograr que estos chips se comuniquen entre sí cuando llegan al punto en el que son tan rápidos que simplemente están sentados esperando la mayor parte del tiempo? ” dijo Harris. Los chips Lightmatter funcionan tan rápido que no pueden depender de los núcleos informáticos tradicionales para coordinarse entre ellos.

Un problema fotónico, al parecer, requiere una solución fotónica: una placa de interconexión a escala de oblea que utiliza guías de ondas en lugar de fibra óptica para transferir datos entre los diferentes núcleos. Las conexiones de fibra no son exactamente lentas, por supuesto, pero no son infinitamente rápidas, y las fibras en sí son bastante voluminosas en las escalas en las que están diseñados los chips, lo que limita la cantidad de canales que puede tener entre los núcleos.

“Construimos la óptica, las guías de ondas, en el propio chip; podemos colocar 40 guías de ondas en el espacio de una sola fibra óptica ”, dijo Harris. “Eso significa que tiene muchos más carriles operando en paralelo, lo que lo lleva a velocidades de interconexión absurdamente altas”. (Los fanáticos de los chips y servidores pueden encontrar esas especificaciones aquí).

La placa de interconexión óptica se llama Passage y será parte de una generación futura de sus productos Envise, pero al igual que con el cálculo del color, es para una generación futura. Un rendimiento de cinco a diez veces mayor a una fracción de la potencia tendrá que satisfacer a sus clientes potenciales por el momento.

Poniendo esos $ 80 millones a trabajar

Esos clientes, inicialmente los manipuladores de datos de “hiper-escala” que ya poseen centros de datos y supercomputadoras que están maximizando, recibirán los primeros chips de prueba a finales de este año. Ahí es donde se dirige principalmente la ronda B, dijo Harris: “Estamos financiando nuestro programa de acceso temprano”.

Eso significa tanto construir hardware para enviar (muy caro por unidad antes de que se produzcan las economías de escala, sin mencionar las dificultades actuales con los proveedores) como construir el equipo de lanzamiento al mercado. Servicio, soporte y la inmensa cantidad de software que acompaña a algo como esto: hay muchas contrataciones en curso.

La ronda en sí fue dirigida por Viking Global Investors, con la participación de HP Enterprise, Lockheed Martin, SIP Global Partners e inversores anteriores GV, Matrix Partners y Spark Capital. Lleva el total recaudado a unos 113 millones de dólares; Hubo la ronda inicial A de $ 11 millones, luego GV subió con un A-1 de $ 22 millones, luego estos $ 80 millones.

Aunque hay otras empresas que persiguen la computación fotónica y sus aplicaciones potenciales en redes neuronales especialmente, Harris no parecía sentir que estaban pisando los talones de Lightmatter. Pocos, si alguno, parecen estar cerca de enviar un producto y, en cualquier caso, este es un mercado que se encuentra en medio de su momento de palo de hockey. Señaló un estudio de OpenAI que indica que la demanda de computación relacionada con la inteligencia artificial está aumentando mucho más rápido de lo que la tecnología existente puede proporcionar, excepto con centros de datos cada vez más grandes.

La próxima década traerá presión económica y política para frenar ese consumo de energía, tal como hemos visto con el mundo de las criptomonedas, y Lightmatter está listo y listo para proporcionar una alternativa eficiente y poderosa a la tarifa habitual basada en GPU.

Como Harris sugirió anteriormente, con suerte, lo que ha hecho su compañía es potencialmente transformador en la industria, y si es así, no hay prisa: si hay una fiebre del oro, ya han apostado su reclamo.