Los robots son cosas increíbles, pero fuera de sus dominios específicos son increíblemente limitados. Así que la flexibilidad, no física, sino mental, es un área constante de investigación. Un trío de configuraciones robóticas nuevas demuestra las formas en que pueden evolucionar para adaptarse a situaciones novedosas: usar ambas “manos”, levantarse después de una caída y comprender las instrucciones visuales que nunca antes han visto.

Los robots, todos desarrollados de forma independiente, se reúnen hoy en un número especial de la revista Science Robotics dedicada al aprendizaje. Cada uno muestra una nueva forma interesante en la que los robots pueden mejorar sus interacciones con el mundo real.

Por otra parte…

Primero está la cuestión de usar la herramienta adecuada para un trabajo. Como humanos con pinzas multiusos en los extremos de nuestros brazos, tenemos bastante experiencia con esto. Entendemos de toda una vida de tocar cosas que necesitamos usar este agarre para recoger esto, necesitamos usar herramientas para eso, esto será liviano, pesado, etc.

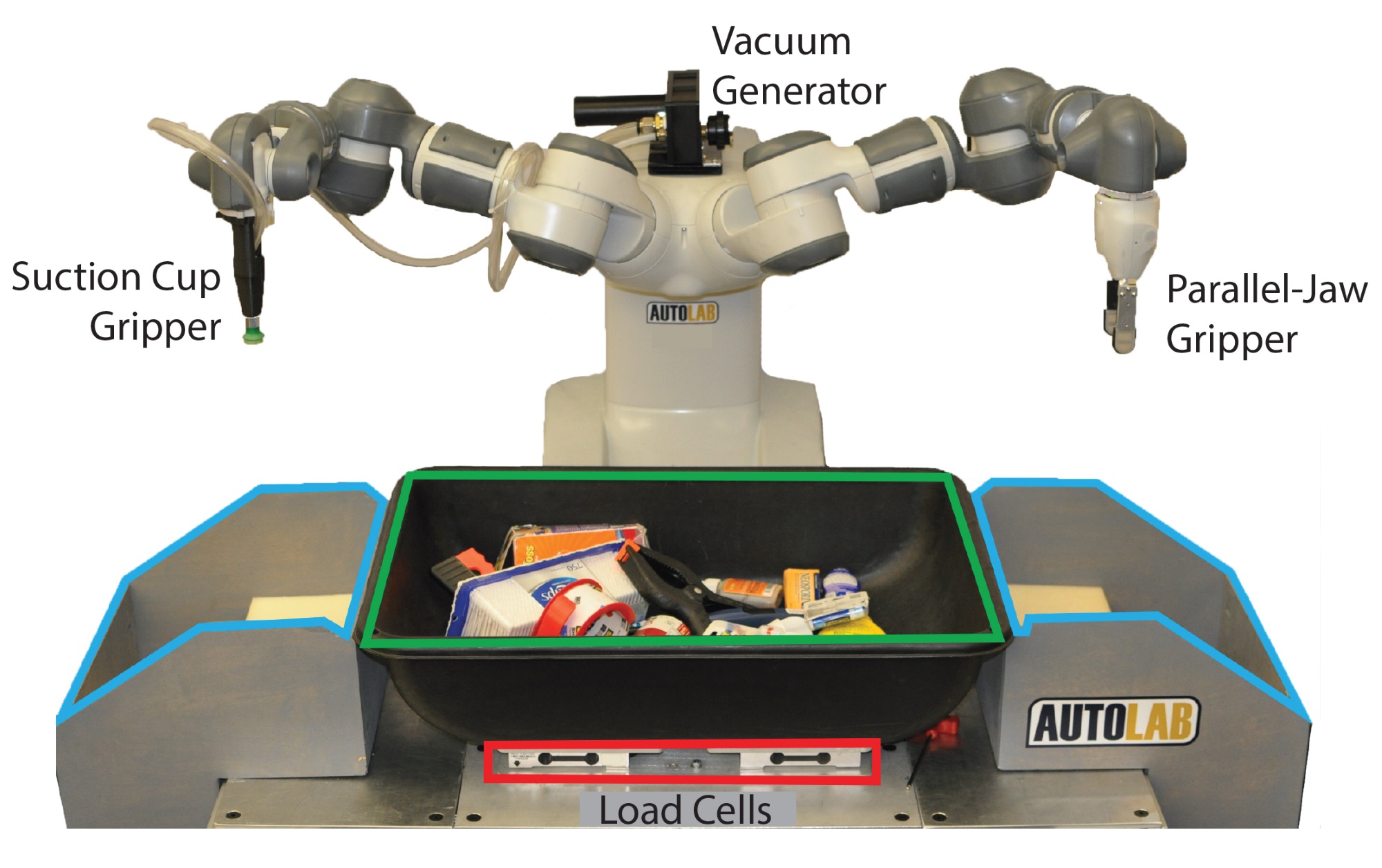

Los robots, por supuesto, no tienen conocimiento inherente de esto, lo que puede dificultar las cosas; puede que no entienda que no puede recoger algo de un tamaño, forma o textura dados. Un nuevo sistema de roboticists de Berkeley actúa como un proceso rudimentario de toma de decisiones, clasificando objetos como capaces de ser agarrados por un agarre de pinza ordinario o con un agarre de ventosa.

Un robot, empuñando ambos simultáneamente, decide sobre la marcha (utilizando imágenes basadas en profundidad) qué elementos agarrar y con qué herramienta; el resultado es una confiabilidad extremadamente alta incluso en pilas de objetos que nunca se han visto antes.

Se realiza con una red neuronal que consume millones de puntos de datos en elementos, arreglos e intenta capturarlos. Si intentara recoger un oso de peluche con una ventosa y no funcionó las primeras diez mil veces, ¿seguiría intentándolo? Este sistema aprendió a tomar ese tipo de determinación, y como puede imaginarse, tal cosa es potencialmente muy importante para tareas como la selección de almacenes para las cuales se están preparando robots.

Curiosamente, debido a la naturaleza de “caja negra” de las redes neuronales complejas, es difícil decir en qué se basa exactamente Dex-Net 4.0, aunque hay algunas preferencias obvias, explicó Ken Goldberg de Berkeley en un correo electrónico.

“Podemos tratar de inferir algo de intuición, pero las dos redes son inescrutables en el sentido de que no podemos extraer” políticas comprensibles “”, escribió. “Encontramos empíricamente que las superficies planas suaves alejadas de los bordes generalmente tienen una buena puntuación en el modelo de succión y los pares de puntos antípodas generalmente tienen una buena puntuación para la pinza”.

Ahora que la fiabilidad y la versatilidad son altas, el siguiente paso es la velocidad; Goldberg dijo que el equipo está “trabajando en un nuevo y emocionante enfoque” para reducir el tiempo de cómputo de la red, que se documentará, sin duda, en un futuro documento.

Los nuevos trucos de ANYmal

Los robots cuadrúpedos ya son flexibles, ya que pueden manejar todo tipo de terreno con confianza, incluso recuperándose de resbalones (y, por supuesto, de patadas crueles). Pero cuando caen, caen. difícil. Y en general no se levantan.

La forma en que estos robots tienen sus patas configuradas hace que sea difícil hacer las cosas en otra posición que no sea una posición vertical. Pero ANYmal, un robot desarrollado por ETH Zurich (y que puede recordar de su pequeño viaje a la alcantarilla recientemente), tiene una configuración más versátil que le da a sus piernas grados adicionales de libertad.

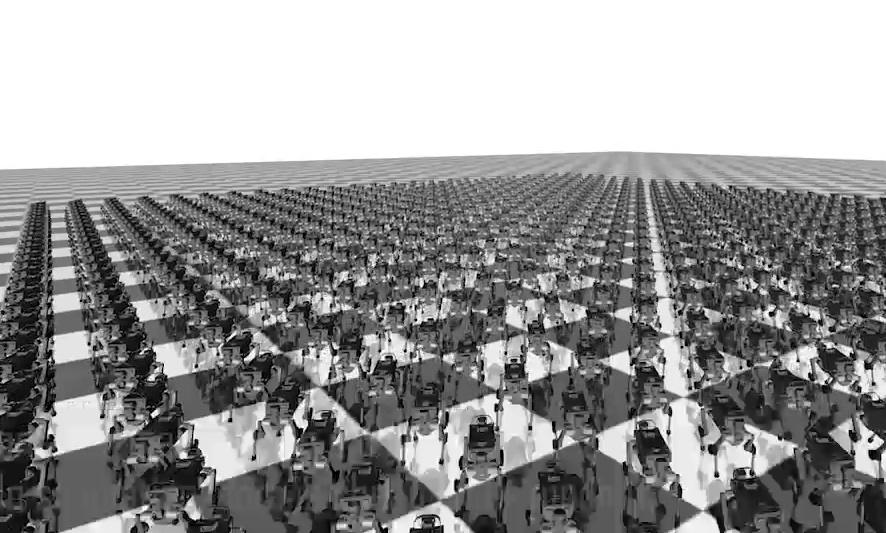

¿Qué podrías hacer con ese movimiento extra? Toda clase de cosas. Pero es increíblemente difícil descubrir la mejor manera exacta de mover el robot para maximizar la velocidad o la estabilidad. Entonces, ¿por qué no usar una simulación para probar miles de ANYmals probando diferentes cosas a la vez, y usar los resultados de eso en el mundo real?

Este aprendizaje basado en la simulación no siempre funciona, porque en este momento no es posible simular con precisión toda la física involucrada. Pero puede producir comportamientos extremadamente novedosos o racionalizar los que los humanos creían que ya eran óptimos.

En cualquier caso, eso es lo que hicieron los investigadores aquí, y no solo llegaron a un trote más rápido para el bot (arriba), sino que también le enseñaron un nuevo truco sorprendente: levantarse de una caída. Cualquier caída. Ver este:

Es extraordinario que el robot haya desarrollado esencialmente una sola técnica para ponerse de pie desde casi cualquier posición de caída, siempre que tenga espacio y el uso de todas sus patas. Recuerda, gente No diseñé esto: la simulación y los algoritmos evolutivos se idearon al probar miles de comportamientos diferentes una y otra vez y mantener los que funcionaron.

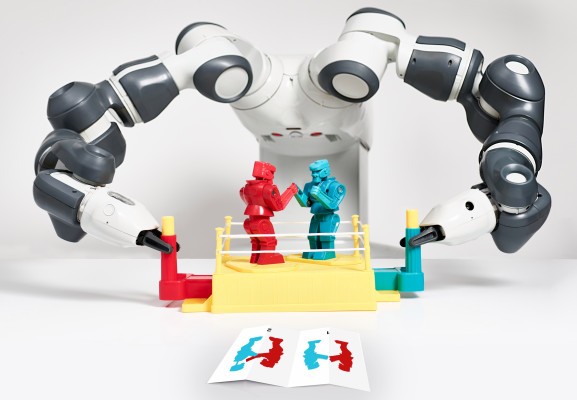

Asamblea Ikea es la aplicación asesina.

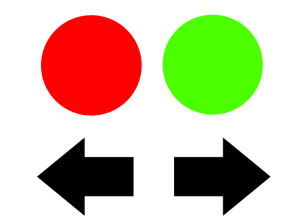

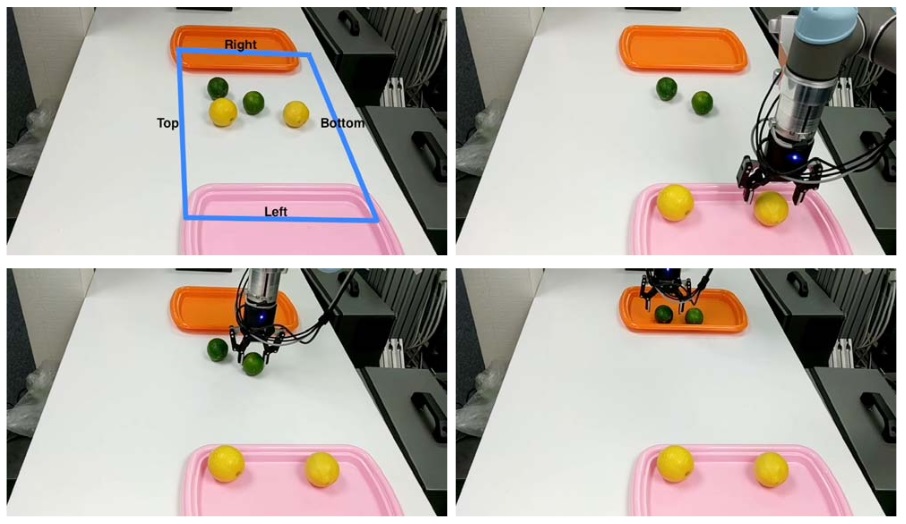

Digamos que te dieron tres tazones, con bolas rojas y verdes en el centro. Luego, se te da esto en una hoja de papel:

Como humano con cerebro, toma este papel para recibir instrucciones, y comprendes que los círculos verde y rojo representan bolas de esos colores, y que los rojos tienen que ir hacia la izquierda, mientras que los verdes van hacia la derecha.

Esta es una de esas cosas en las que los humanos aplican vastas cantidades de conocimiento y comprensión intuitiva sin siquiera darse cuenta. ¿Cómo elegiste decidir los círculos que representan las bolas? ¿Por la forma? Entonces, ¿por qué las flechas no se refieren a flechas “reales”? ¿Cómo sabes a qué distancia ir a la derecha oa la izquierda? ¿Cómo sabes que el documento se refiere a estos artículos? Todas las preguntas que resolvería en una fracción de segundo, y cualquiera de las cuales podría afectar a un robot.

Los investigadores han dado algunos pasos pequeños para poder conectar representaciones abstractas como la anterior con el mundo real, una tarea que involucra una cantidad significativa de lo que equivale a una especie de creatividad o imaginación.

Hacer la conexión entre un punto verde sobre un fondo blanco en un diagrama y una cosa redondeada verdosa sobre un fondo negro en el mundo real no es obvio, pero la “computadora cognitiva visual” creada por Miguel Lázaro-Gredilla y sus colegas en Vicarious Parece que la IA lo está haciendo bastante bien.

Por supuesto, todavía es muy primitivo, pero en teoría es el mismo conjunto de herramientas que se usa para, por ejemplo, ensamblar una pieza de mobiliario Ikea: ver una representación abstracta, conectarla con objetos del mundo real y luego manipular esos objetos de acuerdo con las instrucciones. Estamos a muchos años de eso, pero no hace mucho tiempo estábamos lejos de que un robot se levantara de una caída o decidiera que una ventosa o pinza funcionaría mejor para recoger algo.

Los documentos y videos que muestran todos los conceptos anteriores deben estar disponibles en el sitio de Science Robotics.