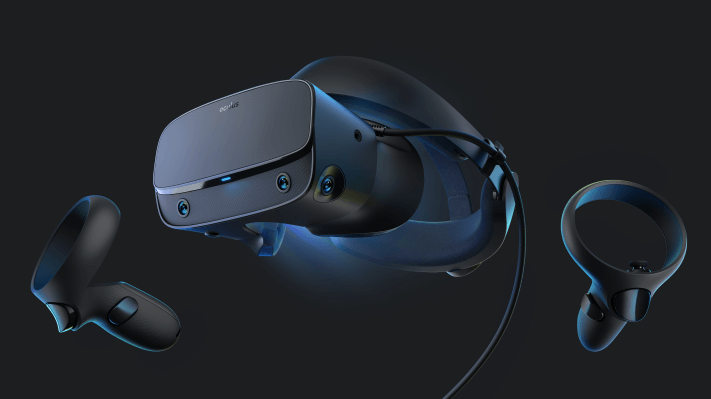

Hacer que la experiencia de realidad virtual fuera simple y portátil era el objetivo principal de Oculus Quest, y definitivamente logra eso. Pero pasar de cosas en la habitación que rastrea sus auriculares a su auricular que rastrea cosas en la habitación fue un proceso complejo. Hablé con el CTO de Facebook Mike Schroepfer (“Schrep”) sobre el viaje de “afuera hacia adentro” a “adentro hacia afuera”.

Cuando mueve la cabeza y las manos con unos auriculares y controladores de realidad virtual, alguna parte del sistema tiene que rastrear exactamente dónde están esas cosas en todo momento. Hay dos maneras en que esto generalmente se intenta.

Un enfoque es tener sensores en la habitación en la que se encuentra, observando de cerca los dispositivos y sus LED integrados, mirando desde afuera hacia adentro. El otro es tener los sensores en los auriculares, que observan las señales en la habitación. de adentro hacia afuera.

Ambos tienen sus méritos, pero si desea que un sistema sea inalámbrico, su mejor opción es de adentro hacia afuera, ya que no tiene que enviar señales de forma inalámbrica entre los auriculares y la computadora haciendo el seguimiento de la posición real, lo que puede agregar latencia odiada a la experiencia

Facebook y Oculus estableció un objetivo hace unos años para lograr no solo el seguimiento de adentro hacia afuera, sino que sea tan bueno o mejor que los sistemas cableados que se ejecutan en PC de alta gama. Y tendría que ejecutarse en cualquier lugar, no solo en una escena establecida con límites establecidos por balizas o algo así, y hacerlo unos segundos después de ponerlo. El resultado es el impresionante auricular Quest, que tuvo éxito con éxito en esta tarea (aunque no es un gran salto en otras).

Lo impresionante de esto no es solo que puede rastrear objetos a su alrededor y traducirlo a una posición 3D precisa de sí mismo, sino que puede hacerlo en tiempo real en un chip con una fracción de la potencia de una computadora ordinaria.

“No conozco ningún sistema que esté cerca de este nivel de rendimiento”, dijo Schroepfer. “En los primeros días hubo muchos debates sobre si funcionaría o no”.

Nuestra esperanza es que, a largo plazo, para la mayoría de las aplicaciones de consumo, todo será un seguimiento de adentro hacia afuera.

El término para lo que hace el auricular es localización y mapeo simultáneos, o SLAM. Básicamente significa construir un mapa de su entorno en 3D mientras se da cuenta de dónde se encuentra en ese mapa. Naturalmente, los robots han estado haciendo esto durante algún tiempo, pero generalmente usan hardware especializado como lidar y tienen un procesador más potente a su disposición. Todos los auriculares nuevos tendrían cámaras normales.

“En un almacén, puedo asegurarme de que mi iluminación sea correcta, puedo poner fiduciales en la pared, que son marcadores que pueden ayudar a restablecer las cosas si obtengo errores, eso es como una simplificación dramática del problema, ¿sabes?”, Señaló Schroepfer. fuera. “No te estoy pidiendo que coloques fiduciales en tus paredes. No le hacemos poner códigos QR o coordenadas GPS posicionadas con precisión alrededor de su casa.

“Nunca antes había visto tu sala de estar, y solo tiene que funcionar. Y en un entorno informático relativamente limitado, tenemos una CPU móvil en esto. Y la mayor parte de esa CPU móvil también va al contenido. El robot no está jugando Beat Saber al mismo tiempo que está navegando por el almacén “.

Es un problema difícil en múltiples dimensiones, por lo que el equipo ha estado trabajando en ello durante años. Finalmente, varios factores se unieron. Una fue simplemente que los chips móviles se volvieron lo suficientemente potentes como para que algo como esto sea posible. Pero Facebook realmente no puede tomar crédito por eso.

Más importante fue el trabajo continuo en visión por computadora que la división de inteligencia artificial de Facebook ha estado haciendo bajo la supervisión de Yann Lecun y otros allí. Los modelos de aprendizaje automático introducen gran parte del procesamiento necesario para los problemas de visión por computadora, y los motores de inferencia resultantes son más livianos, si no necesariamente se comprenden bien. Poner en funcionamiento el aprendizaje automático eficiente y orientado a los bordes redujo este problema más cerca de tener una posible solución.

Sin embargo, la mayor parte del trabajo se centró en las complejas interacciones de los múltiples sistemas que interactúan en tiempo real para realizar el trabajo SLAM.

“Desearía poder decirte que es solo esta fórmula realmente inteligente, pero hay muchas cosas para que esto funcione”, dijo Schroepfer. “Por ejemplo, tiene una IMU en el sistema, una unidad de medición inercial, y funciona a una frecuencia muy alta, quizás 1000 Hz, mucho más alta que el resto del sistema [i.e. the sensors, not the processor]. Pero tiene muchos errores. Y luego ejecutamos el rastreador y el mapeador en hilos separados. Y, de hecho, realizamos múltiples subprocesos en el mapeador, porque es la parte más cara [i.e. computationally]. Para empezar, la programación de subprocesos múltiples es una tarea difícil, pero usted lo hace a través de estos tres, y luego comparten datos de maneras interesantes para acelerarlo “.

Schroepfer se contuvo aquí; “Tendría que pasar como tres horas para llevarlo a través de todas las partes sucias”.

Parte del proceso también fue una prueba exhaustiva, para la cual utilizaron una plataforma comercial de seguimiento de movimiento como verdad fundamental. Seguirían a un usuario jugando con los auriculares y los controladores, y utilizando la configuración OptiTrack miden los movimientos precisos realizados.

Pruebas con el sistema OptiTrack.

Para ver cómo funcionaban los algoritmos y el sistema de detección, básicamente reproducían los datos de esa sesión en una versión simulada: video de lo que veía la cámara, datos de la IMU y cualquier otra métrica relevante. Si la simulación estaba cerca de la verdad sobre el terreno que habían recolectado externamente, bien. Si no fuera así, el sistema de aprendizaje automático ajustaría sus parámetros y volverían a ejecutar la simulación. Con el tiempo, el sistema más pequeño y eficiente se acercó cada vez más a la producción de los mismos datos de seguimiento que el equipo OptiTrack había registrado.

En definitiva, tenía que ser tan bueno o mejor que los auriculares Rift estándar. Años después del original, nadie compraría un auricular que fuera un paso atrás de ninguna manera, sin importar cuánto más barato fuera.

“Es una cosa que decir, bueno, mi tasa de error en comparación con la verdad básica es lo que sea, pero ¿cómo se manifiesta en términos de toda la experiencia?”, Dijo Schroepfer. “Cuando nos acercamos al final del desarrollo, en realidad teníamos un par de apasionados jugadores de Beat Saber en el equipo, y jugarían en la Grieta y en la Búsqueda. Y el objetivo era que la misma persona debería poder obtener la misma puntuación más alta o mejor. Esa fue una buena manera de restablecer nuestras micro métricas y decir, bueno, esto es lo que realmente necesitamos para lograr la experiencia final que la gente quiere “.

el equipo de visión por computadora aquí, son bastante optimistas con las cámaras con algoritmos realmente poderosos detrás de ellos que son la solución a muchos problemas.

No está de más que también sea más barato. Lidar es lo suficientemente caro como para que incluso los fabricantes de automóviles tengan cuidado de cómo lo implementan, y los enfoques de tiempo de vuelo o luz estructurada como Kinect también elevan el costo. Sin embargo, simplifican enormemente el problema, ya que son herramientas de detección 3D para empezar.

“Lo que dijimos fue: ¿podemos ser igual de buenos sin eso? Porque reducirá drásticamente el costo a largo plazo de este producto ”, dijo. “Cuando estás hablando con el equipo de visión por computadora aquí, son bastante optimistas con las cámaras con algoritmos realmente poderosos detrás de ellos que son la solución a muchos problemas. Por lo tanto, esperamos que a largo plazo, para la mayoría de las aplicaciones de consumo, todo será un seguimiento de adentro hacia afuera “.

Señalé que la realidad virtual no es considerada por todos como una industria saludable, y que las soluciones tecnológicas pueden no hacer mucho para resolver un problema de más capas.

Schroepfer respondió que básicamente hay tres problemas que enfrenta la adopción de VR: costo, fricción y contenido. El costo se explica por sí mismo, pero sería un error decir que se ha vuelto mucho más barato con los años. Playstation VR estableció una entrada de bajo costo desde el principio, pero la VR “real” se ha mantenido cara. La fricción es lo difícil que es pasar de “abrir la caja” a “jugar un juego”, e históricamente ha sido un punto de fricción para la realidad virtual. Oculus Quest aborda estos dos problemas bastante bien, con un precio de $ 400 y, según nuestra revisión, es muy fácil de recoger y usar. Todo ese trabajo de visión por computadora no fue para nada.

Sin embargo, el contenido aún es escaso en el suelo. Ha habido algunos éxitos, como Superhot y Beat Saber, pero nada que realmente atraiga a las multitudes a la plataforma (si se le puede llamar así).

“Lo que estamos viendo es, a medida que sacamos estos auriculares, y en manos de los desarrolladores, las personas tienen todo tipo de ideas creativas. Creo que estamos en las primeras etapas: estas plataformas tardan un poco en marinarse “, admitió Schroepfer. “Creo que todos deben ser pacientes, va a tomar un tiempo”. Pero esta es la forma en que nos acercamos a él, solo vamos a seguir conectando, creando mejor contenido, mejores experiencias, mejores auriculares tan rápido como podamos “.